所有文章

NoteGen 是一款跨平台的 Markdown 笔记应用,支持 Windows、Mac、Linux。它最大的特点,是把“记录”和“写作”这两步分开,并通过 AI 助手帮你把零散的内容自动整理成结构化

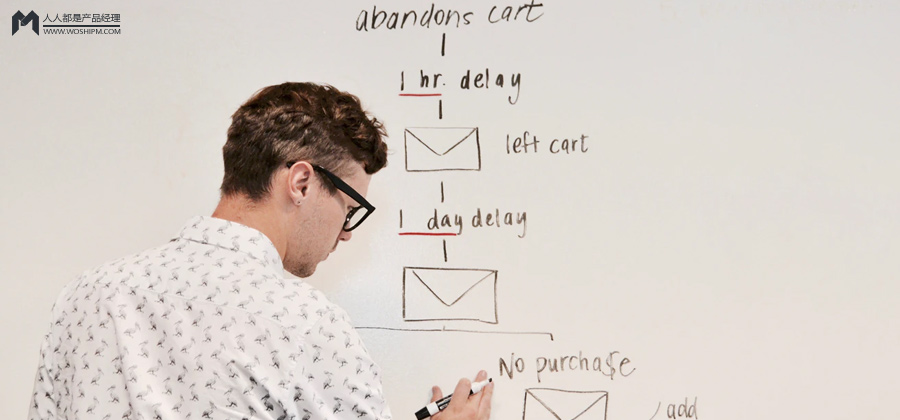

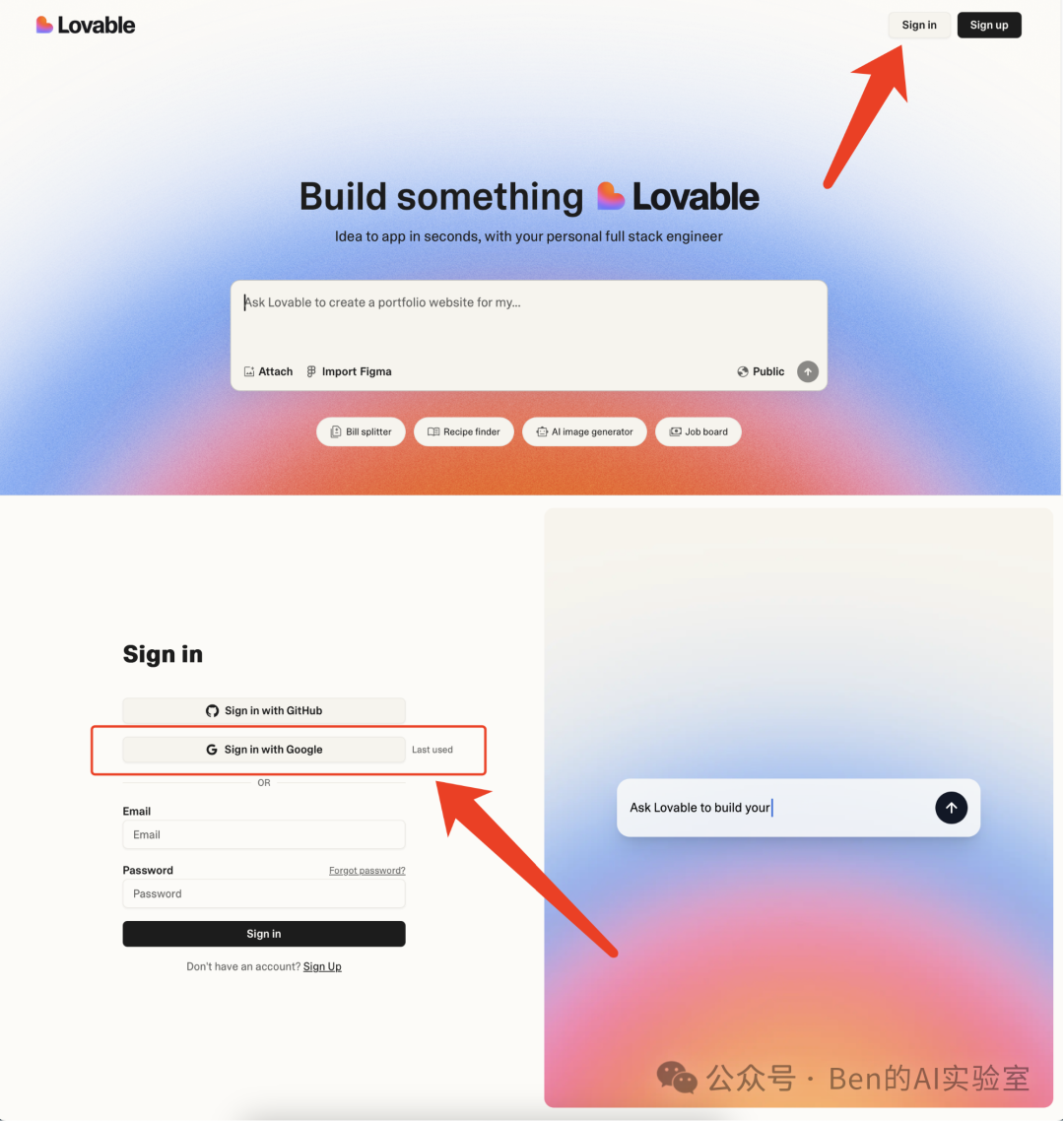

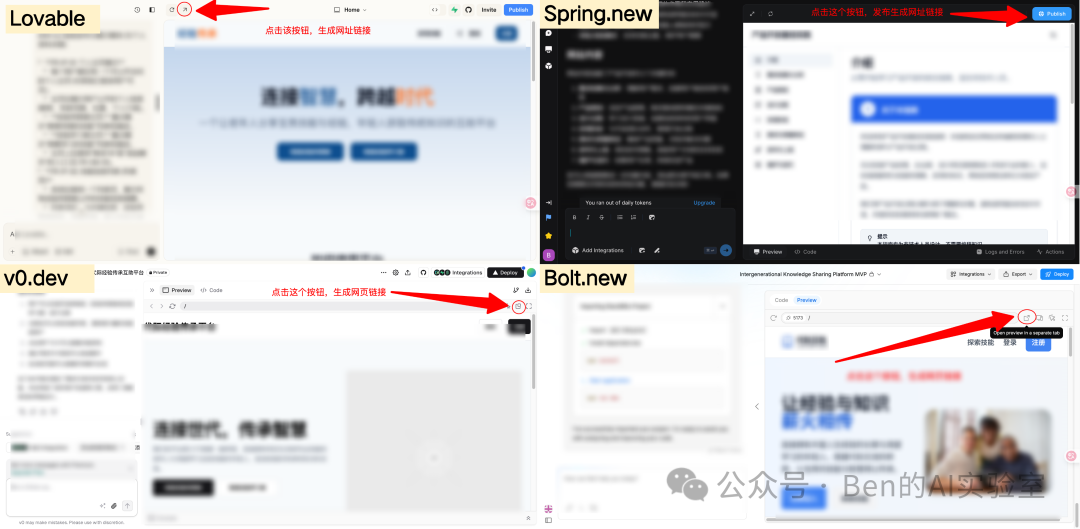

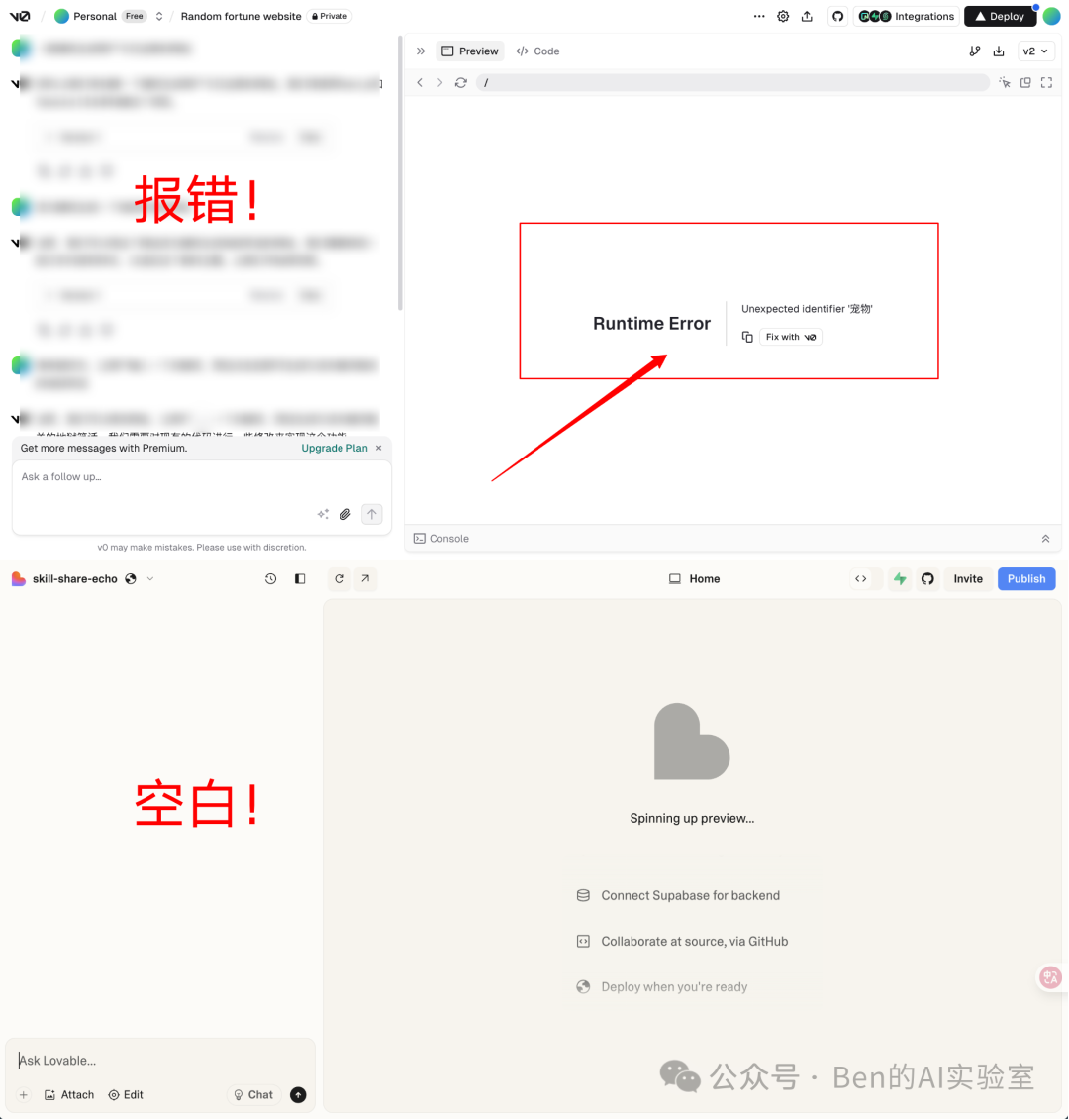

<blockquote><p>自上一篇政企产品经理AI工作流介绍发布后,身边不少同行朋友尝试并反馈:</p> <p>由于不熟悉与AI工具的交互,因此卡点很多容易劝退。</p> <p>因此,本篇将聚焦【需求 → 原型】阶段,通过一个实操项目,分享详细的工具使用、提示词技巧和一些心得,希望对感兴趣的同学有所帮助。</p> </blockquote>  ## 前置准备:工具 & 心态 ### 1. 工具准备 上网工具(强烈建议):这将使你访问各类工具更加丝滑。 Google账号(强烈建议):本文所有推荐工具都支持Google一键登录,简化注册流程。 浏览器收藏夹分类(强烈建议):创建两个收藏夹,分别存放大模型网站(GPT/DeepSeek等)和AI原型构建工具(Lovable/v0等)。浏览器通常支持一键打开收藏夹所有网页,这个功能在同时给多个AI工具派活时非常提效。 ### 2. 心态调整 - AI只会做你说的,而不是你想的:很多时候你以为你说清楚了,实际上并没有。如果不信,不妨将你给AI的提示词发给朋友,看他能否不追问的情况下就理解你要做什么。不过别急,后文我也提供了提示词模板。 - 输出内容具有随机性,保持耐心:一击即中是少数,千万不要因单次效果不佳而全盘否定AI的能力。效果不好看上一条。从需求到最终产品,可能涉及数百次交互,耐心是关键。 <blockquote><p>✏️关于下文的示例项目:</p> <p>本想拆解过往项目(www.aiben.cc),发现复现困难或不便公开。</p> <p>因此,索性从0开始做一个新项目,并进行详细记录。不过仅为演示工作流所用,并非商业产品开发流程,跳过了市场洞察与可行性分析等过程。</p> <p>话休烦絮,我们开始!</p></blockquote> ## 一、需求整理:从模糊到清晰 ### 1. “倾倒”想法 需求的初始形态往往是零散的:会议记录、口头描述、初步想法等。 别担心格式或结构,先将所有想法“倾倒”出来,结合提示词交给AI帮你梳理。 比如我这个项目初始想法: 过年时,看到奶奶为儿女准备粿和粽子,这让我意识到,自己和许多同龄人并不掌握这些传统手艺。 同时,身边很多长辈身怀各种“绝技”(如毛笔字、手工艺等),若不传承,这些宝贵技能可能会逐渐消失。 由此萌生一个想法:能否创建一个平台,连接对某项技能感兴趣的年轻人与掌握该技能的老年人?让长辈的知识和经验得以传承,惠及年轻一代。 ### 2. AI梳理需求 这个初始需求还比较模糊,仅是一个有初步构想。接下来让AI梳理,明确需求框架。 我同时向GPT-4o、Gemini和 DeepSeek 发出请求,让它们分析这个想法。 提示词如下: <blockquote><p># 角色你是一位经验丰富的产品经理和需求分析师。</p> <p># 背景</p> <p>我正在构思一个[老年人与年轻人之间经验传承的平台]。</p> <p># 原始需求</p> <p>1.信息发布功能:-老年人(姓名,年龄,愿意传授的技能,位置)-年轻人(姓名,年龄,想要学习的技能,位置)</p> <p>2.搜索和匹配功能</p> <p>3.聊天功能</p> <p>4.同时支持web和手机端</p> <p>5.……</p> <p># 任务</p> <p>请帮我将以上这些零散模糊的需求进行结构化整理和分析,输出一份清晰、有条理的需求文档。</p> <p># 注意事项</p> <p>请务必确保输出的需求符合最小可行性原则,不要肆意扩充需求以免增加项目开发难度。</p></blockquote> AI们的反馈如下:  ### 3. 人工审核 读了各AI的回复后,我认为Gemini的输出最贴近我的初衷。 在其基础上稍作修改,形成了以下MVP(最小可行产品)需求文档: <blockquote><p># 项目名称:代际经验传承互助平台 (MVP)</p> <p>## 1. 引言</p> <p>本需求文档旨在为“代际经验传承互助平台”的最小可行性产品(MVP)阶段提供核心功能和非功能性需求定义。平台的核心目标是搭建一座桥梁,连接拥有特定生活或专业技能的老年人与渴望学习这些技能的年轻人,促进经验的传承和知识的交流。MVP阶段将专注于实现用户信息的发布、搜索匹配及基础沟通能力。</p> <p>## 2. 项目目标 (MVP阶段)</p> <p>* 验证代际间技能传承的意愿和模式可行性。</p> <p>* 实现用户(老年人、年轻人)的基本信息注册和发布。</p> <p>* 提供基于技能和位置的基础搜索和匹配功能。</p> <p>* 支持用户间的初步在线文字交流。</p> <p>* 为后续迭代收集用户反馈。</p> <p>## 3. 用户角色</p> <p>本平台MVP阶段主要服务两类用户:</p> <p>* **经验传授者 (老年人用户):**愿意分享自己的技能、经验或知识的老年人群体。</p> <p>* **经验学习者 (年轻人用户):**希望学习特定技能、获取人生经验或知识的年轻人群体。</p> <p>## 4. 核心功能需求 (Functional Requirements)</p> <p>基于MVP原则,我们将核心功能分为以下几个模块:</p> <p>### 4.1 用户管理模块</p> <p>* **FR-UM-01: 用户注册**</p> <p>* 用户应能够通过手机号+验证码或邮箱+密码的方式注册账户。</p> <p>* 注册时用户需选择自己的角色:经验传授者 (老年人) 或 经验学习者 (年轻人)。</p> <p>* 注册时需填写基本信息(详见 FR-UM-02)。</p> <p>* **FR-UM-02: 个人资料创建与编辑**</p> <p>* **通用信息 (注册时必填,后续可编辑):**</p> <p>* 昵称 (建议使用昵称保护隐私)</p> <p>* 年龄范围 (如: 50-60岁, 60-70岁, 70岁以上 / 18-25岁, 25-35岁) – MVP阶段不要求精确年龄。</p> <p>* 所在城市/区域 (精确到区县级别即可,保护隐私)。</p> <p>* 简单的个人介绍/宣言。</p> <p>* **经验传授者 (老年人) 专属信息:**</p> <p>* 愿意传授的技能列表 (支持用户输入技能名称/关键词,可添加多个)。</p> <p>* 技能描述 (简要说明能传授的内容)。</p> <p>* **经验学习者 (年轻人) 专属信息:**</p> <p>* 想要学习的技能列表 (支持用户输入技能名称/关键词,可添加多个)。</p> <p>* 学习目标/描述 (简要说明想学什么)。</p> <p>* 用户应能够随时修改自己的个人资料信息。</p> <p>* **FR-UM-03: 登录与退出**</p> <p>* 用户应能够使用注册凭证(手机号/邮箱 + 密码/验证码)登录。</p> <p>* 用户应能够主动退出当前登录状态。</p> <p>### 4.2 信息发布与展示模块 (与个人资料关联)</p> <p>* **FR-IP-01: 个人主页展示**</p> <p>* 每个用户都应有一个可公开访问的个人主页 (对其他已登录用户可见)。</p> <p>* 主页应展示用户公开的个人信息 (昵称、年龄范围、位置、个人介绍)。</p> <p>* **经验传授者主页:**重点展示“愿意传授的技能”列表和描述。</p> <p>* **经验学习者主页:**重点展示“想要学习的技能”列表和描述。</p> <p>* 主页上应提供“联系TA”或“发起聊天”的入口 (见 FR-CM-01)。</p> <p>* **FR-IP-02: 技能信息列表 (列表页)**</p> <p>* 系统应提供一个列表页,展示所有经验传授者公开的技能信息摘要。</p> <p>* 列表项应包含关键信息:经验传授者昵称、年龄范围、部分技能关键词、位置。</p> <p>### 4.3 搜索与发现模块</p> <p>* **FR-SD-01: 技能搜索**</p> <p>* 经验学习者应能够在技能信息列表页通过输入技能关键词进行搜索。</p> <p>* 搜索结果应展示包含该关键词的经验传授者列表。</p> <p>* **FR-SD-02: 位置筛选**</p> <p>* 经验学习者应能够根据城市/区域筛选经验传授者列表。</p> <p>* 可以与技能搜索结合使用 (搜索某个位置的某种技能)。</p> <p>### 4.4 沟通模块</p> <p>* **FR-CM-01: 发起聊天**</p> <p>* 在用户主页或搜索结果/列表页,用户可以点击按钮向对方发起聊天。</p> <p>* 发起聊天后,双方进入聊天会话界面。</p> <p>* **FR-CM-02: 文字聊天**</p> <p>* 在聊天会话界面,双方应能够发送和接收文字消息。</p> <p>* 聊天界面应显示消息发送时间和发送方。</p> <p>* **FR-CM-03: 会话列表**</p> <p>* 用户应能够查看所有正在进行或已有的聊天会话列表。</p> <p>* 列表应显示会话的对方昵称和最新一条消息摘要。</p> <p>## 5. 非功能性需求 (Non-Functional Requirements)</p> <p>* **NFR-PF-01: 平台支持**</p> <p>* MVP版本先满足Web端浏览器访问,不做移动端。</p> <p>* **NFR-US-01: 可用性**</p> <p>* 界面设计应简洁明了,考虑到老年用户的操作习惯 (如字体大小、按钮清晰度)。</p> <p>* 核心流程(注册、发布信息、搜索、聊天)应流畅易懂。</p></blockquote> ### 4. 本节小结 - 记录原始想法:将初步需求写下来,不必追求结构和格式。 - AI辅助梳理需求:利用大模型(如上文提示词示例)将杂乱信息归类、提炼,形成结构化需求框架。 - 人工审核确认:微调AI生成的内容,删除不必要信息(比如AI的客套话),确保符合初衷。 判断是否可以进入下一步的标准: 这份需求文档能否回答:“这个产品/项目,最终是为了解决谁的什么问题?想要达到什么样的核心目标/结果?” 如果能,则基本合格,进入下一步! ## 二、原型设计:让AI把想法具象化 有了清晰的需求文档,下一步是让AI工具构建原型。这个过程充满惊喜,你会看到想法迅速变为可见可交互的界面。 我的原型成果链接如下,想先看下效果的可以点击查看(建议电脑端打开): Lovable 生成的原型:https://preview–legacy-learn-share.lovable.app/ Bolt.new 生成的原型:https://elde-youth-bridge-bolt.netlify.app/ ### 1. 工具简介 热门产品:v0.dev, Lovable, Spring.new, Bolt.new 等。这些工具均为国外开发,界面为英文。 - 功能:这类AI工具被称为“NL to APP”(自然语言构建应用)。与返回文本的大模型不同,它们能根据你的指令完成产品设计、搭建技术框架、编写代码,并提供实时可预览的Web应用。 - 注册:首次使用通过Google账号一键登录(需科学上网)。若无,则需邮箱注册。 - 价格:都提供免费试用额度(如每日对话次数或Token限制)。例如,Lovable免费版每日限5次对话。付费订阅一般在20美元/月左右,丰俭由人。 我的策略:同时使用多个工具完成同一任务,进行“赛马”,择优采用,也能有效利用免费额度。  ### 2. 开始构建 **step1:一次性打开收藏夹中的多个工具,将整理好的需求文档输入。**  **step2:工具接收指令后,会开始分析需求并构建应用。** 界面通常左右布局:左侧为对话区,右侧为预览/代码区。 无需担心代码,构建完成后会自动跳转到预览界面(若无跳转可尝试刷新)。  **step3:构建过程中可能出现如下报错。别担心,它们都提供了【Fix with AI】的按钮。点击让AI尝试自行修复。**  step4:AI构建过程中,可以去喝杯茶,[点击前往原文查看录屏](https://mp.weixin.qq.com/s/M92logSxguniCbcZrxHESg): step5:等待约5-8分钟,大功告成,开始审阅AI的成果,[点击前往原文查看录屏](https://mp.weixin.qq.com/s/M92logSxguniCbcZrxHESg): step6:生成的原型可以通过链接分享查看。 - Lovable和v0.dev生成的链接可直接分享给他人访问。 - Spring.new需要对方登录。 - Bolt.new目前暂不支持直接分享链接查看。  ### 3. 常见问题 **问题1:反复报错 / 空白没有预览画面等:** 可能原因:需求描述过于复杂或有歧义;工具本身临时性问题。 解决方案: - 点击“Fix with AI”或类似按钮尝试修复。 - 简化需求描述,开启新会话重试。 - 更换其他AI原型工具,千万不要耗着。  **问题2:整体效果不满意:** 可能原因:输入的需求指令不够清晰;AI理解偏差或随机生成效果不佳。 解决方案: - 记录不满意点:具体列出问题(例如:颜色太花哨、布局太拥挤、缺少某些关键功能等)。 - 开启新对话 (推荐):同一个工具新建会话或换一个工具,重新输入核心需求,并明确加入对不满意点的反向要求。例如:“请确保应用采用极简风格,配色朴素,主色调不超过三种。” - 在当前基础上对话修改:尝试通过对话让AI调整。但这容易陷入反复拉扯,且会较快耗尽免费额度。 **问题3:部分效果不满意:** 具体表现:某个组件、某个细节不符合预期。 解决方案: - 截图+对话:截图指出具体位置,用文字描述修改要求。例如:“截图中的【发送】按钮位置太靠下,请将其高度与旁边的输入框对齐。” - 直接修改(部分工具支持):如Lovable提供“Edit”功能,允许直接在预览区修改文字、调整组件大小边距等。   ### 4. 本节小结 - 重视首轮提示词:首轮指令质量很大程度决定原型基础。若效果不佳且越改越乱,不如优化指令后重新开始。 - 抓大放小:此阶段目标是获得一个框架合理、主要功能齐全、风格大致符合要求的原型骨架,而非追求完美的最终产品(除非需求极简)。 - 接受不完美:允许存在细节瑕疵(如图标、间距),这些问题可在后续“工程化实现”阶段精调。 ## 三、总结回顾 **前置准备** - 备好科学上网工具和Google账号,提升效率。 - 整理好工具收藏夹,便于快速访问多个工具。 - 接受AI输出的随机性,拥抱迭代过程。 **需求整理** - 先自由记录想法,再利用大模型进行结构化梳理。 - 人工审核并微调,明确产品核心目标与范围。 **原型设计** - 多试不同的“NL to APP”工具,不同的工具会给你不同的惊喜。 - 有报错就点“Fix with AI”,没画面就刷新会重开会话。 - 接受初步结果的不完美,获取满意的原型骨架即可。 ✏️小贴士 - 保存有效提示词:请及时保存效果好的提示词,构建模板库,方便复用。 - 了解前端基础(按需):适当学习前端知识有助于理解和修改原型。 - 关注工具更新:AI工具迭代迅速,新功能可能带来更爽的体验。 希望本文细化的步骤和技巧,能助你顺利跑通AI工作流的前半段! 在后续的文章中,我将继续讲解如何将原型转化为可运行的最小可行性产品,包括项目导入、环境配置、产品功能调整、部署上线和PRD文档撰写等流程。 未完待续…… 作者:Ben的AI实验室 公众号:Ben的AI实验室 本文由 @Ben的AI实验室 原创发布于人人都是产品经理。未经作者许可,禁止转载 题图来自Unsplash,基于CC0协议 该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务

最新发现,一个名为“Scallywag”的大规模广告欺诈操作,通过精心制作的WordPress插件,每天产生数十亿的欺诈请求,从盗版和URL缩短网站中获利。 Scallywag是由机器人和欺诈检测公司HUMAN发现的,该公司绘制了一个由407个域名组成的网络,支持该操作,最高时每天有14亿个欺诈性广告请求。 HUMAN阻止和报告Scallywag流量的行为导致其减少了95%,尽管威胁者通过轮换域名和转向其他货币化模式显示出了弹性。 **围绕WordPress广告欺诈插件构建** 由于法律风险、品牌安全问题、广告欺诈和缺乏高质量的内容,合法的广告提供商会避免盗版和网址缩短网站。 Scallywag是一个围绕四个WordPress插件建立的欺诈即服务运营,帮助网络罪犯从高风险和低质量的网站中赚钱。 该操作创建的WordPress插件是Soralink(2016年发布),Yu Idea(2017年),WPSafeLink(2020年)和Droplink(2022年)。 Human表示,多个独立的威胁者购买并使用这些WordPress插件来建立自己的广告欺诈计划,有些人甚至在YouTube上发布教程,详细说明如何做到这一点。 这些扩展降低了潜在威胁者的进入门槛,他们想要从通常无法通过广告获利的内容中获利;事实上,一些威胁者已经发布了视频来指导其他人建立自己的计划。 Droplink是这种销售模式的唯一例外,因为它可以通过为卖家执行各种赚钱步骤而免费获得。 访问盗版目录网站查找电影或高级软件的用户点击嵌入的url缩短链接,并通过该操作的现金支付基础设施被重定向。 不能直接投放广告的盗版目录网站不一定是由Scallywag运营的。相反,它们的运营商与广告欺诈者结成了“灰色伙伴关系”,将盈利外包出去。  盗版网站(左)链接到Scallywag网站(右) 重定向过程将访问者带过中间的大量广告页面,这些页面会给Scallywag运营商带来欺诈性印象,并最终进入一个包含承诺内容(软件或电影)的页面。 中间站点是运行Scallywag插件的WordPress站点。这些处理重定向逻辑,广告加载,验证码,计时器和隐形机制,它显示一个干净的博客在广告平台检查。  Scallywag的操作概述 **破坏Scallywag** HUMAN通过分析其合作伙伴网络中的流量模式来检测Scallywag活动,例如来自看似良性的WordPress博客的高广告印象量,伪装行为,以及在重定向之前强制等待时间或CAPTCHA交互。  直接访问(左)和通过url缩短器访问(右)的同一站点 随后,它将Scallywag列为欺诈网络,与广告提供商合作,停止对广告请求的竞标,并削减了Scallywag的收入来源。 作为回应,Scallywag的参与者试图通过使用新的现金支付域名和打开重定向链来隐藏真正的推荐者来逃避检测,但HUMAN表示他们也检测并阻止了这些。  Scallywag请求随时间的推移 结果,Scallywag的每日广告欺诈流量从14亿急剧下降到几乎为零,许多分支机构放弃了这种方法,转而采用其他骗局。 尽管Scallywag生态系统在经济上已经崩溃,但它的运营商很可能会继续试图逃避缓解措施,重新盈利。

<blockquote><p>在企业财务管理中,费用入账是确保财务信息准确性和支持企业决策的关键环节。本文详细介绍了费用入账的基本原则,包括合法性、真实性、合理性和及时性,并深入探讨了几种常见的费用入账方法,如直接计入法、间接计入法、分期摊销法和预提法。</p> </blockquote>  在财务管理中,费用入账是一项至关重要的工作。准确、及时地将各类费用入账,不仅能够保证财务信息的真实性和可靠性,还能为企业的决策提供有力的支持。 ## 01 费用入账的基本原则 (一)合法性原则费用入账必须符合国家相关法律法规和企业内部的财务制度规定。 (二)真实性原则入账的费用必须是真实发生的,有合法有效的凭证作为依据。 (三)合理性原则费用的发生应当合理,与企业生产经营活动直接相关,并符合经济业务的常规。 (四)及时性原则费用应在发生的当期及时入账,不得提前或滞后。 ## 02 费用入账的几种常见方法 ### 1. 直接计入法 对于可以直接归属于某一成本核算对象或特定费用项目的费用,如办公费、差旅费等,直接计入相应的成本或费用科目。 流程: - 经济业务发生,取得原始凭证。 - 经办人员填写报销单,并附上原始凭证。 - 财务人员审核报销单和原始凭证的真实性和合规性。 - 根据费用性质和用途,直接将其计入相应的会计科目。 ### 2. 间接计入法 对于不能直接归属于某一成本核算对象或特定费用项目的费用,如车间管理人员工资、折旧费等,需要按照一定的分配标准间接计入。 流程: - 计算分配率,分配率 = 待分配费用总额÷分配标准总额。 - 按照各成本核算对象或受益部门的分配标准数量,计算应分配的费用金额。 - 将计算出的费用金额计入相应的会计科目。 ### 3. 分期摊销法 对于一些需要在多个会计期间受益的费用,如租赁费、广告费等,按照其受益期限分期摊销入账。 流程: - 确定费用的受益期限和摊销方法(如直线法、双倍余额递减法等)。 - 计算每期应摊销的金额。在每个会计期间,将摊销金额计入相应的费用科目。 ### 4. 预提法 对于一些尚未实际支付,但按照权责发生制原则应当在本期确认的费用,如预提利息、租金等,提前进行预提入账。 流程: - 根据合同或协议,确定预提费用的金额和预提期限。 - 在每个预提期间,按照预提金额计入相应的费用科目,并增加负债。 - 收到发票时,冲销预提金额并按实际票面金额入账。 需要注意的是,预提法分为三步法(暂估、计提、冲销暂估)、五步法(暂估、计提、冲销暂估、付款、冲销计提),具体可见:[费用确认中的“五步法”及产品设计](https://www.woshipm.com/share/5985043.html) ## 03 费用入账的产品设计 费用入账过程会涉及到报销、预算、分摊(计提)、入账等系统或模块,不同企业做IT规划设计或实施时,上述功能模块或系统可能搭建在ERP或费用控制系统里,或OA里,或财务中台,根据企业实际情况而定。系统没有最好的,只有最适合的! ### 1. 费用报销系统 功能模块 - 报销申请:员工在线填写报销单,选择费用类型,上传原始凭证照片。 - 部门审批:部门负责人对报销申请进行初审,核实费用的真实性和合理性。 - 财务审核:财务人员对报销单和凭证进行复审,检查合规性和准确性。 - 支付处理:审核通过后,自动将费用计入相应的会计科目,并安排资金支付。 流程设计 **员工提交报销申请 → 部门审批 → 财务审核 → 支付处理 → 报销记录查询** ### 2. 费用预算控制系统 功能模块 - 预算编制:各部门根据年度经营计划编制费用预算。 - 预算执行监控:实时跟踪费用的实际发生情况,与预算进行对比分析。 - 预警提示:当费用接近或超过预算时,自动发出预警通知。 流程设计 **预算编制 → 预算审核 → 预算执行 → 监控与分析 → 预警与调整** 数据分析与报告 生成费用预算执行情况的报表和分析图表,为管理层决策提供依据。 ### 3. 费用分摊/预提系统 功能模块 - 规则设置:根据企业的实际情况,设定费用分摊/预提的方法和标准;冲销预提的规则,如哪些科目适用三步法、哪些适用五步法;是整冲整提、还是余额冲销或取大法冲销。 - 自动分摊/预提计算:系统根据设定的规则,自动计算各成本核算对象应分摊的费用金额。 - 分摊/预提结果审核:财务人员对分摊结果进行审核和确认。 流程设计 **分摊规则设置 → 数据采集 → 自动分摊计算 → 分摊结果审核 → 入账处理** 系统集成 与财务核算系统、成本管理系统等进行集成,实现数据的无缝对接。 ## 04 案例分析 以一家饮料研发、生产制造企业为例,其生产过程中发生了车间水电费、设备折旧费、管理人员工资等费用。 对于车间水电费,采用暂估预提计入法,按照各车间的产量比例进行分摊。费用分摊系统根据预先设定的产量比例计算各车间应分摊的金额,自动入账。费用报销系统归集水电费发票,经过部门审批和财务审核后,冲销原暂估金额后再计提水电费。 设备折旧费采用分期摊销法,根据设备的预计使用年限和残值,采用直线法计算每期的折旧额。费用预提系统按照设定的折旧计划,每月自动进行折旧费用的预提入账。 管理人员工资采用直接计入法,通过费用报销系统提交工资发放申请,经过审批后,直接计入管理费用科目。 作者:业财老曾,公众号:业财老曾谈,专注财务信息化20年 本文由 @业财老曾 原创发布于人人都是产品经理,未经许可,禁止转载。 题图来自 Unsplash,基于CC0协议。 该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

过去一年,中国企业出海交出了一份亮眼答卷。 新能源汽车驰骋海外街道、跨境电商订单量持续攀升、科技应用席卷全球用户……越来越多中国品牌以创新为矛、技术为盾,在国际市场上攻城略地,用实打实的成绩证明“中国智造”的硬核实力。 如今,“中国智造”已不再是追随者,而是凭借在技术、产品、服务等方面的创新与突破,逐渐成长为全球行业标准的制定者、高端品牌的开拓者。 在新一轮全球化浪潮中,中国企业的出海模式正经历系统性升级:从单打独斗到集群作战,逐步构建起属于自己的全球商业生态“朋友圈”。 当前,全球经济形势进入动荡调整期,国际贸易格局正在系统性重构。这给中国企业带来了供应链重塑等挑战,也为中国企业开拓新兴市场、抢占行业制高点创造了新机遇。在充满不确定性的环境中,中国企业出海全球化正展现出极强的韧性与活力。 **作为深耕科技创新与商业生态的新型服务平台,36 氪持续关注中国企业出海全球化进程。**从早期的产品出海,到如今的品牌出海、模式出海,我们始终聚焦行业最前沿,挖掘成功背后的方法论,为更多企业提供借鉴与参考。 基于对中国企业出海全球化趋势的深度洞察,**36氪正式启动East Forward 2025出海全球化创新名册评选活动**,聚焦 “领航人物”、“创新人物” 和 “创新企业” 三大核心维度,挖掘在全球化浪潮中的表现卓越的领航者与企业,树立行业标杆,助力中国创新力量走向全球舞台中央。 **East Forward 2025 出海全球化创新名册** 评选规则&报名指南如下  本文来自微信公众号[“36氪”](https://mp.weixin.qq.com/s/_6WCA3BAyhHBm5yADJxrRw),36氪经授权发布。

据央视新闻报道,**今天我国第二艘国产大型邮轮完成坞内起浮,标志着邮轮项目整体进度已完成超过70%,全面转入内装和系统完工调试阶段。**随后,工作人员对邮轮进行了全船残余应力释放、测定重量重心等一系列关键工艺要素和技术指标的检验,进一步系统验证了国产大型邮轮在设计、工艺、总装建造等阶段所取得的重大科研成果,堪称一场“期中考”。 [](//img1.mydrivers.com/img/20250428/7560e0ad-04c1-4464-acd3-300f36b38b33.png) **按计划,第二艘国产大型邮轮将在2026年5月出海试航,计划2026年年底交付,在交付前还要通过10.8万项的全船检验。** **与第一艘国产大型邮轮不同的是,第二艘的监造团队也从外国团队换成了中国本土团队。**  相比于首艘国产大型邮轮“爱达·魔都号”,“爱达·花城号”总吨位更大,**相较于首艘船总吨位增加0.64万吨,达到14.19万吨,总长增加17.4米,达341米。** 舱房数增至2130间,满载游客量可达5232人。  同时,舱内设计和布局得到优化,新增多种套房房型,中庭面积扩大一倍,内装设计深度加入了海上丝路、岭南风情等多元文化,并以“花卉”为主线。 船上配置了高达16层的生活娱乐区域,设有大型演艺中心、大型餐厅、特色餐馆、艺术走廊等丰富的休闲娱乐设施。  [查看评论](https://m.cnbeta.com.tw/comment/1495882.htm)

4月28日,《日经亚洲》周末发文称,中国电动汽车市场的快速发展推动技术标准快速演变,导致日系车企难以单打独斗,无法仅凭自身实力参与市场竞争,于是丰田汽车、日产汽车以及本田汽车开始纷纷与中国科技公司合作,设计更加智能的电动汽车。  丰田、本田以及日产都在与中国公司合作 丰田专为中国市场设计了首款电动轿车铂智7,这是丰田首款搭载华为鸿蒙操作系统的车型。鸿蒙已被其他汽车制造商用于智能座舱系统,能够通过触摸屏控制窗户、空调和座椅位置等功能。日产、本田也正在与中国智能驾驶公司Momenta合作,分别为其新款N7、Ye电动汽车配备高级辅助驾驶系统。N7和Ye车型都是专门为中国市场打造的。 “为了在中国推出人们想要的汽车,我们的开发需要中国人的智慧和才干。”丰田中国总经理李晖在上海车展上称。 《日经亚洲》指出,这三家日本汽车制造商在2000年代开始与中国公司合作,启动了在中国的全面生产。它们在中国的总销量在2020年达到了创纪录的488万辆。然而,在电动汽车领域,他们落后了。随着中国市场对新能源汽车的需求日益增长,他们面临挑战。2024年,这三大日本车企在华总销量较峰值时已下降了大约30%。 “这里(中国)出现了新的‘汽车文化’,所以我们需要向当地人才和合作伙伴学习。”一位参加2023年上海车展的丰田高管曾表示。 随着电动汽车在中国的普及,竞争焦点已转向了自动驾驶技术和智能座舱等车载技术。比亚迪和其他中国企业正在加速开发新技术,而日本汽车制造商面向中国市场推出的新产品可能会迅速落伍。 不过,在中国获得的技术专长将有助于日本车企更好地在其他市场中竞争。丰田中国总经理李晖称,丰田CEO佐藤恒治(Koji Sato)说过,丰田将利用在中国这一前沿市场开发的产品和技术,推动全球业务增长。 [查看评论](https://m.cnbeta.com.tw/comment/1495880.htm)

近日在一场直播中,被问及“欠你360借条的钱可以不还吗?”,360集团创始人、董事长周鸿祎表示,“那不是我的公司。”360借条的实际运营主体是奇富科技。 公开资料显示,360金融最初作为360集团旗下的金融业务孵化成立,2018年6月独立运营,同年12月在纳斯达克上市。2020年8月,公司从360金融更名为360数科,强调科技属性,并于2022年11月在港交所二次上市。2023年2月,360数科再次更名为奇富科技,进一步淡化360标签,强化金融科技定位。 周鸿祎曾担任奇富科技的董事及董事会主席,但已于2024年8月辞任相关职务,不再直接参与管理。不过,根据奇富科技2024年财报资料,截至2024年末,周鸿祎仍通过Aerovane Company Limited间接持有奇富科技16%的股份,为公司第一大股东。  [查看评论](https://m.cnbeta.com.tw/comment/1495878.htm)

贵州道真自治县近日发生一起生态保护争议事件。**一名参与招商考察的女子赤脚进入大磏镇奥陶纪晶花池拍照,相关视频引发公众对溶洞生态保护的担忧。****该晶花池是在水利工程中意外发现的封闭洞穴系统,池内沉积物形成需4.8亿年时间。** [](//img1.mydrivers.com/img/20250428/0a8771cc5070474ca0c46ffd404c75bc.png) 中国地质学会洞穴专业委员会秘书长张远海对此表示严重关切,**指出人体油脂、化妆品等外来物质会破坏沉积物的化学平衡,专业考察人员都严格遵守"不踩水"的基本原则。** 据了解,涉事女士系当地招商对象,自称获得许可后已四次进入该洞穴考察。 **目前,当地文旅部门已确认涉事者身份,并全面封闭该洞穴。**事件暴露出在招商引资与生态保护平衡方面存在的管理漏洞,相关部门正就事件展开进一步调查。 专家呼吁,对珍稀地质遗迹应建立更严格的保护制度,避免类似事件再次发生。 [](//img1.mydrivers.com/img/20250428/7c43722472704b309bd5a936b0ffd0d1.png) [查看评论](https://m.cnbeta.com.tw/comment/1495876.htm)

最近,日产汽车发布了全新Elgrand的预告图,**这款中大型MPV将在2025年内推出,预计2026年或2027年上市,未来有望登录中国市场。** [](//img1.mydrivers.com/img/20250428/9b886529-4f40-4f7e-a6dc-d2f3c90a2d4f.png) 新车外观借鉴了日产Hyper Tourer概念车的设计语言,前脸配备贯穿式灯带,大灯内部是矩阵式风格光源,还配备可发光车标。 前格栅采用无边界风格设计,车身侧面有镀铬条装饰,车尾采用贯穿式尾灯组,整体造型时尚大气。 此外,新车还将提供多种座舱布局,包括四座版车型,满足不同用户的需求。 预计还将搭载最新的ProPilot ADAS组合辅助驾驶功能,提升驾驶便利性和安全性。 [](//img1.mydrivers.com/img/20250428/2b7e7c04-521b-4949-8970-9da25d3b82d6.png) **而全新日产Elgrand最大的亮点是搭载了第三代e-Power动力系统。** 这套系统采用“燃油发电、全时电驱”的工作模式,发动机只负责发电,不直接驱动车轮,驾驶体验非常接近纯电动车。 [](//img1.mydrivers.com/img/20250428/fbc6733d-24ae-4fe7-a299-9c24e4481698.png) 看到这里,大家可能会疑惑,这不就是国内目前流行的增程吗? **其实不然,日产e-POWER与增程式系统的差别主要有二:** 1.**日产e-POWER动力技术只加油不充电,没有对充电基础设施的依赖;**而增程式本质上是插电混动的一种,既需要充电,也需要加油。 2.多数增程式电动车为确保纯电续航里程,需要背负大容量的电池,但日产e-POWER动力技术在合理的动力系统匹配与控制策略执行的情况下,可以将电池容量尽可能降低,能源结构更加优化。 **所以,相比其它动力系统,日产e-POWER相比纯电动,它没有续航焦虑,也不用担心低温影响;相比油电混动,它是纯电驱动,起步加速相应更快、驾驶更平顺、噪音也更小;相比插电混动,它无需充电,无需背大电池,综合能耗更低。** [](//img1.mydrivers.com/img/20250428/d02f0e6d-be0b-4c69-a0fa-f918e3cf29d4.png) 据了解,日产Elgrand最早于1997年推出,目前发展到第三代车型。 在海外市场,它的主要竞争对手是丰田埃尔法和威尔法,这两款车型在国内市场的指导价格区间为89.90万-92.90万元。 全新日产Elgrand的推出,无疑将为中大型MPV市场带来新的选择,如果该车引入国内,你会选择它吗? [查看评论](https://m.cnbeta.com.tw/comment/1495866.htm)

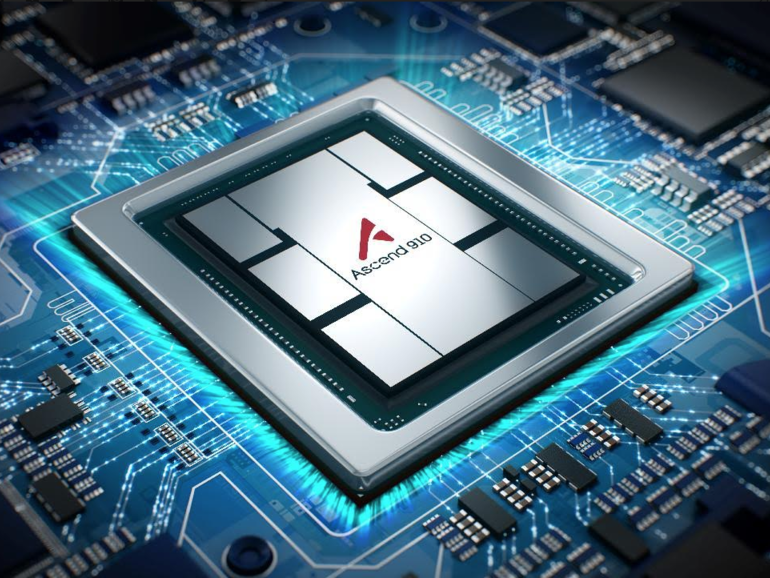

难怪这么多中国科技公司,黄仁勋唯独公开称赞华为。根据最新报道,市场传出,**华为准备测试旗下最新、最强大的AI 芯片昇腾(Ascend)910D,直接对标NVIDIA的高端AI芯片。**  消息人士透露,华为已开始接洽部分中国合作伙伴,讨论910D技术可行性的测试事宜。 据悉,**华为最快5月就能取得910D首批样本。**当然, 一切尚在初期阶段,之后仍需要一系列测试来评估处理器性能,为供应客户做好准备。 华为期望,**最新一代昇腾AI处理器的性能能超越NVIDIA 2022年发布的热门AI训练芯片H100。** 目前,华为已经推出910B、910C,性能较NVIDIA竞品尚有不小差距。 **4月早些时候,美国将特供中国市场的H20芯片加入出口管制名单,NVIDIA也因此认列55亿美元费用。** 这也让NVIDIA的中国竞争对手(诸如华为、寒武纪)有了更多国产替代的机会。 预计,今年华为昇腾910B及910C的出货量将超过800,000颗,客户包括中国电信运营商和民营AI开发商(例如TikTok母公司字节跳动)。美国出手管制H20出口后,部分买家已开始跟华为商谈要加码下订910C。 今年3月20日,**NVIDIA CEO黄仁勋接受采访时公开点赞华为,并直言“华为是中国最强大的科技公司,征服了他们涉足的每一个市场。”** 黄仁勋表示,美国主导限制中国科技巨头的努力“搞得很糟糕”。据悉,NVIDIA已连续两年将华为列入竞争对手名单。 [查看评论](https://m.cnbeta.com.tw/comment/1495864.htm)

小鹏汽车官宣,小鹏智能辅助驾驶安心服务正式上线。据悉,**小鹏智能辅助驾驶安心服务售239元/年,最高可赔偿100万**,具有四大优势:覆盖场景全(行车及泊车)、保险公司广(5家头部保险公司)、赔付不限次、全车系可享。 更为重磅的是,小鹏汽车表示,这套服务是**行业唯——NGP退出后5秒内仍可享受的权益**。 那么该如何购买?小鹏汽也给出了指引:今日起,**下单购买小鹏保险(交强险+商业险)后,即可在小鹏汽车APP-服务-保险服务-智能辅助驾驶安心服务点击购买**。 与此同时,小鹏汽车也给出了“小字”提示,具体如下: 1、“行业唯一”:本结论基于截至发稿时车企发布的智能辅助驾驶保障产品公开信息得出,若市场出现类似产品,以实际情况为准。 2、“全场景":**含智能辅助行车和泊车功能。** 行车功能指导航辅助驾驶NGP、AI代驾、车道巡航辅助LCC,其保障期间从行车功能激活时起,至退出后满5秒止; 泊车功能指超级智能辅助泊车 APA(含离车泊入、智能出库、智能泊出辅助)、停车场记忆泊车 VPA、循迹倒车,其保障期间从泊车功能激活时起,直至退出之时。 3、本服务是针对小鹏汽车智能辅助驾驶功能的服务权益,不取代交强险和机动车商业险,**本服务推出后,在小鹏汽车官方合作渠道购买车险的新保及续保客户才可购买**,享权条件详见《智能辅助驾驶安心服务协议》。 4、智能辅助驾驶功能并非自动驾驶,该功能使用期间,驾驶员而非系统为车辆的控制者,驾驶员仍需对路况保持警惕并随时准备接管车辆。 5、本服务由小鹏汽车对客提供,由多家头部保险公司为小鹏汽车提供保险方案。 [](//img1.mydrivers.com/img/20250428/fd19dd50-9c98-466c-83b4-7dbc00c46b7b.jpg) [查看评论](https://m.cnbeta.com.tw/comment/1495862.htm)

美国加利福尼亚州州长加文·纽森23日宣布,根据权威数据统计,加州2024年名义国内生产总值(GDP)已超过日本,成为全球第四大“经济体”。 加州州长办公室当天发布新闻通报说,根据国际货币基金组织(IMF)22日发布的最新《世界经济展望报告》数据和美国商务部经济分析局发布的各州最新GDP数据,2024年加州名义GDP达到4.1万亿美元,超过日本的4.02万亿美元。因此,加州如果作为一个单独“经济体”计算,全球排名第四,仅次于美国、中国和德国。  这是2021年10月29日在美国加利福尼亚州洛杉矶港拍摄的装满了集装箱的货船。新华社发 通报说,加州是美国经济支柱,带动全美经济增长;加州向联邦政府缴纳的资金比从联邦政府获得的资金多约830亿美元;加州是美国最主要农业区,也是美国制造业产出中心,拥有超过3.6万家制造企业,雇用超过110万当地居民。 纽森宣布上述成就的同时,再次批评总统唐纳德·特朗普政府的关税政策。他说:“我们的发展正受到现任联邦政府不计后果关税政策的威胁。加州经济带动美国前行,因此必须得到保护。” 纽森上周向联邦法院提起诉讼,质疑特朗普援引紧急状态法律提高关税的合法性,称“这些关税损害了各州、消费者和企业”利益。 通报说,关税乱象破坏了股市和债券市场稳定,造成数以千亿计美元的损失,并提高了消费者和企业的成本。特朗普关税政策预计导致美国经济每年收缩1000亿美元。 [查看评论](https://m.cnbeta.com.tw/comment/1495860.htm)

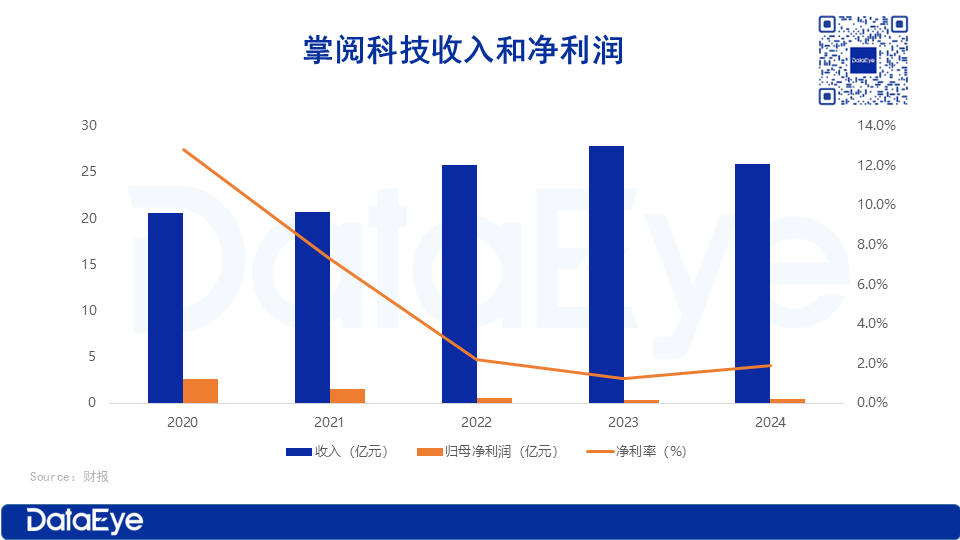

<blockquote><p>京东外卖在上线后短时间内取得了显著的成绩,日订单量突破1000万单,引发了行业的广泛关注。然而,京东的目标并非成为第二个美团,而是通过外卖业务实现流量增长和即时零售的突破。本文将深入分析京东外卖的快速增长背后的战略布局,探讨其与美团的竞争态势,以及京东如何通过外卖业务巩固其在零售领域的核心竞争力,同时为消费者和商家提供差异化的价值。</p> </blockquote>  京东和美团的外卖大战,从刘强东请骑手吃火锅开始,就已经从口水仗升级为肉搏战了。这两天,除了短视频平台上“扫黄出饿”的梗,“京东黑板报”推送的一组数据也引起业内的热议: 4月22日,晚上8点19分 京东外卖当日订单量突破1000万单  ## 1000万单,是什么概念 做个类比,抖音外卖,做到第五个月时,日订单量为10万单左右;饿了么当前日订单量约为2000万单,美团日订单大概在7800万单左右。 横向对比,从京东外卖正式上线到日单量500万单,用时46天,而从日单量500万到1000万,京东外卖仅用一周左右的时间。业内专家李成东算了一笔账:(京东)干到现在1000万单,投入不会超过40亿,如果30日内冲2000万单 (≈饿了么),投入不会超过60亿。 京东能在短时间内取得如此战果,既有战略和执行层面的称道之处,比如京东外卖上线后,主要做了三件“大事”:为骑手交社保、做品质外卖、上线百亿补贴;也有舆论上的意外收获,比如刘强东亲自下场,点燃“外卖市场苦美团久矣”的呼声。 需要补充的是,“京东黑板报”的这条推送,从数据上还能看出两层意思: **一是京东外卖拓城速度变慢。**京东表示,“从外卖的第1单到如今的第1000万单,服务全国166个城市”。而一个月前日订单量突破100万单时,官方公布的数据为142城,“京东外卖平台上,已有超45万家品质堂食餐厅为全国142城用户提供放心、可靠、好吃的餐品。 ” 可以判断,京东初期选择的从线上全面撒网,吸引商家的策略进入调整期,后期将面临美团早期“一城一地”强地推的挑战。 这也不排除京东外卖有意放缓拓城速度,在外卖单量快速增长的时候,快速进行内部算法技术、运力调配以及运营策略的迭代,以适应后续更加激烈的大战。 **二是京东继续强调对用户、骑手和商家的“品质”承诺:** - 让用户吃得放心、安全、实惠 - 为骑手提供有尊严、有保障的工作 - 让坚守品质的堂食餐厅 - 赚到它们应赚的钱 - 让“幽灵外卖”滚出市场 - 劣币不再驱逐良币 这是京东外卖既定的策略,高举“品质外卖”大旗,形成对竞对的舆论以及用户心智势差。 这也是我一直建议的,京东外卖希望速决,但这注定是一场持久战——这也是美团希望的战局,毕竟王兴凭此熬死过太多对手,也成了小王CEO自傲的历史成绩单——就需要持续在“品质外卖”上打透,参考米其林或者大众点评,成为卫生敏感、品质需求型用户的外卖首选,以凸显京东外卖的差异化价值:京东认真做外卖,不负用户每一餐! ## 京东并不是想做第二个美团 **单从订单量看,京东外卖短时间内的突防能力,还是让美团外卖感受到了威胁。但在唐辰看来,日订单量突破1000万单,对京东外卖的意义有限,但对京东的意义很大。或者说,日订单量是衡量京东做外卖是否成功的标准之一,但也只是之一。** **理由很简单:京东并不是想做第二个美团。**京东外卖日订单量无论是1000万单,还是2000万单,即便是做到外卖市场的第一位,其意义对京东来说,也并不是决定性的。 京东CEO许冉之前在业绩电话会上说,不要单独去思考即时零售或者外卖业务,而要结合京东整体零售业务能力和服务体验通盘考虑。 **不难看出,京东外卖订单背后是对流量的争夺。**对京东来说,外卖带来的收益也远不是账面盈亏那么简单。 **这是京东的一轮防守反击战:防守的是美团在即时零售上对京东大本营的偷袭,反击的是传统电商业务进入存量时期对新流量的争夺。** 美团小王CEO王莆中在“口水仗”中点出,“京东不是第一家想做外卖的公司,也可能不是最后一家”。同时,他还道出一个京东否认不了的事实,美团在即时零售业务上跑得太快了,直插京东等传统电商平台的大本营。 他透露,美团非餐饮品类的订单突破了1800万单。另有媒体提及,美团在今年Q1的一次闪购内部沟通会上公布了一组数据,2024年美团闪购3C家电订单量接近京东全站四成,其中电脑办公类商品订单量已超过京东全站,手机通讯类商品订单量超过京东全站四成;美妆品类订单达京东全站三成。 这股压力对以3C起家,自营为主的京东来说,尤为巨大。京东做外卖,是刘强东破局的一招。 **狮子搏兔,尚需全力。这就有了刘强东亲自下场,王莆中对垒的不对称局面。如果能通过外卖业务来完成即时零售的拼图,这无疑相当于打通了京东的第二增长曲线。** 实际上,京东多年来一直在即时零售上布局,比如买菜业务、七鲜业务等。今年更是加大了力度,比如整合“小时达”“京东到家”等品牌,升级推出“京东秒送”、私有化达达以及加码线下超市业态的布局等。 正如我的一位老同事的点评,“用这点补贴的钱来换来每天1000万打开交易,相比存量市场的拉新、老用户激活费用来说,简直不要太划算,同时又能阻击一下势头强劲的对手,一举多得,可以说是非常非常划算的花小钱办大事了!” 他的这个点评拆开来看,就是“防守反击”。身边已经不止一位朋友表示,之前很久没有打开京东,但这轮外卖大战之后,试着点了餐,顺便买了点日用品。这就是美团闪购的逻辑,通过高频需求,稳住流量。 目前,京东已经尝到了甜头。根据QuestMobile最新数据,4月17日,京东App日活跃用户规模1.36亿,较外卖业务上线首日增长2073万,在骑手资源与商家资源争夺方面,达达秒送骑士与京东秒送商家App日活跃用户在4月19日各自分别达到116.3万和101.4万。 ## 万一刘强东真把外卖生意做成了呢 **我对京东的担心是,外卖业务毕竟是重投入、重模式的业务,目前这股势头还能持续多久?这又会牵扯到另外一个问题:刘强东如果真把外卖这件事做成了呢?** **在刘强东下场请骑手吃火锅之前,我一度认为京东可能并没有认真想过这个问题。** 今年2月,京东宣布进军外卖业务时,多数餐饮业以及互联网人士都并不看好,饿了么打了多年,还是在老二的位置,而且市场份额越打越少。而且,外卖和京东物流配送是两个逻辑,京东在这方面有大量的课需要补,直到现在还会出现无骑手接单、配送缓慢等问题。 从官宣到4月初,京东外卖的声量都没有出圈,用户认知也比较模糊。以致于美团对京东也没有引起足够重视,就算刘强东罕见亲自带队,王兴也是作壁上观,没有现身。据36kr报道,有商家称“美团没有像防抖音那样防京东”。 **在这期间,京东虽然还是有意或者无意的挑动美团的神经,希望借力打力,对外发声上还是比较有战术性。**比如许冉在回答媒体提问,谈及及与美团的竞争时,她表示,“外卖行业本就是一个宽广的赛道,第一它市场规模很大,第二增长依然还很快,我认为完全容得下多个平台。” 这话,王兴也说过。腾讯新闻《一线》提到,2019年美团发布第二季度业绩报告时,王兴在财报电话会中表示,“自己相信这个市场的规模足够大,能够容纳几个大的企业。” 他的这番表态正值阿里在排兵布阵,准备在本地生活领域围杀美团的关键时刻。这才有了后来王兴评价阿里饿了么时说,“从战斗力来说,阿里非常强,但如果他们各方面做得更有底线一点,我会更尊敬他们。”现在来看,美团在外卖领域没有对手很多年了,也忘记了当初的谦卑。 直到李斌吃到京东外卖,“刘强东+许冉”密集释放信息,京东外卖的热度再度飙升。京东的高举高打,对美团的打击很有效,至少在舆论和认知层面,让商家和消费者有了很多的触动。 这刺痛了美团,王莆中忍不住站出来对京东外卖“破口大骂”,称其“狗急跳墙”“大而无当”,把口水仗推到肉搏战的阶段。 **某种意义上,王莆中给了京东外卖一记神助攻,帮助京东把“认真做外卖”坐实了。** 如今,京东外卖的体量越来越大,刘强东召集的骑手兄弟越来越多,京东对外卖业务的期待也会在动态调整,其中也包括对外卖业务成败的评判标准。 但**可以明确的是,京东做外卖,也不只是做外卖,路径一旦跑通,外卖业务在京东体系内的战略价值就更加凸显出来。** 相较其他电商平台,京东无疑更加重视这轮大战,后续也会酝酿出更大的风暴,伴随的也是更大的质疑。但对行业、消费者而言,京东搅局,打破美团一家独大的局面,就是好事。 **专栏作家** 唐辰同学,微信公众号:唐辰同学,人人都是产品经理专栏作家。内容链接,洞察与解读,关注互联网科技及商业故事。 本文原创发布于人人都是产品经理。未经许可,禁止转载 题图来自 Unsplash,基于CC0协议 该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

自 GPT-4 发布至今已有两年,但对大语言模型的研究并没有放缓,我们仍处在一个技术进步涌现的时代。Anthropic 于 2024 年11月发布 MCP,成为接通 AI 生态的桥梁,自主的 Agent 工作流距我们更进一步。GPT-4o、GPT-4.1时隔仅一个月先后发布,实现上下文处理能力八倍提升。在国内,DeepSeek 凭借FP8 混合精度训练引发行业震动,Manus发布号称全球首款通用Agent,先后在今年年初掀起全民AI热潮。 前沿方向尚未收敛,技术突破纷至沓来。以月为单位的技术迭代下,如何看清AI行业的最新趋势? 2025年4月26日,雷峰网、AI科技评论 GAIR Live 品牌举办了一场主题为 “顶尖科学家聊 2025 ICLR 最近趋势” 的线上圆桌沙龙。 圆桌主持人为雷峰网高级主编马晓宁,并邀请了南洋理工大学校长讲席教授,人工智能系主任,人工智能交叉研究院院长安波、浙江大学计算机学院百人计划研究员赵俊博、清华大学AIR研究院助理教授赵昊、埃默里大学计算机系副教授刘菲,共同开启了一场深度对话。  交谈过程中,嘉宾们围绕AI技术加速迭代下,LLM决策系统发展及应用方向、Agent前沿趋势、Scaling Law的前景、Diffusion及新模型架构的可能性等多个方面发表了独到见解。 从GPT-4开始,更大规模、更高质量的样本使模型智力不断提升,LLM的能力边界逐步拓展。然而,数据枯竭的隐忧也徘徊在Scaling Law的路径尽头。不久前,David Silver和Richard S. Sutton两位顶尖人工智能技术专家联合发表论文,指出从人类数据中提取的知识正迅速接近极限,高质量数据源大多即将耗尽。 Scaling Law是否已经走到尽头? 对此,赵俊博表示需要对不同领域分别考虑。高质量数据的耗竭已成定局,预训练首当其冲。“人类最高质量的一批token加起来有10~15T,DeepSeek-V3用了14.8T。在这15T数据的基础上,如果接受比较高质量的合成数据,再把数据质量的门开得稍微大一点,差不多能扩展到25~30T,再往上就很难有更多的数据塞进来了。” 有业内人士向AI科技评论指出,当前大模型及大模型产品发展的技术源动力仍为预训练,它直接关系到模型的智力水平。25~30T是预训练数据的上限,也或将成为LLM的天花板。 当算力和样本不足以筑起走向AGI的通天塔,技术层的创新点会成为AI行业迈向下个台阶的关键一招。 回头再看,刘菲对有限数据的分配提出了追问。“现在大家在做基础模型的时候,基本上是把能够拿到的无论是文本还是其它模态的信息,几乎是一股脑地放在预训练当中。然后在后训练阶段,对于不同的领域,会有专门的数据。其实我们可以重新思考一下这个问题,有没有可能有一种比较好的方法,能够把数据在预训练和后训练中合理地分配,最大化地提高模型能力。” 任务创新同样富于潜力。Predict the next word一直是训练大语言模型的出发点,以完成这个任务为导向,模型性能实现了速度、指令遵循、推理能力等方面的全方位提升。刘菲提出:“现在我们能不能通过在任务上的创新,提出新的task,帮助我们提高模型的后训练效果,或者模型在某一个领域需要的特定能力。” 以下是此次圆桌讨论的精彩分享,AI科技评论进行了不改原意的编辑整理: ## 技术迭代,AI “狂飙” AI科技评论:这次我们沙龙的主题是顶尖科学家聊 2025 ICLR 的最新趋势。我们请到了四位嘉宾,分别是浙江大学计算机学院百人计划研究员赵俊博、南洋理工学院校长、人工智能系主任安波、埃默里大学计算机系副教授刘菲、清华大学AIR研究院助理教授、光轮智能首席科学家、智源学者赵昊。今天把四位老师请过来,希望可以跟大家分享一下我们在 ICLR 有什么样的见闻,以及对于接下来人工智能走向和趋势的预测。 我想问四位老师的第一个问题是,大家觉得今年的 ICLR 跟往年比有什么不一样的地方? 赵俊博:我上一次来 ICLR 已经是很多年前了。这个会其实是从我们NYU的实验室split off出去的。14年刚开始的时候也就几百篇论文,没想十一年过去变化会这么大。所以我今年最直接的感受就是人多、论文多、会场大。当年的poster要讲四五个小时,因为当时其实没有那么多的poster,但现在的poster已经压缩到了两个小时的极限。 安波:今年更大一些,有很多来自中国的老师和同学,内容也特别多。今年组织注册那个地方要排一个小时才能领到这个牌子,另外会场显得更加拥挤,通道也比较窄。 我个人觉得这个会太大了,当然也证明这个会的质量很好,来了很多优秀的人。 刘菲:我去年参加了在维也纳的 ICLR 会议,想把去年和今年的做一个对比。我感觉今年的论文在深度和广度方面都是非常棒的,首先我看到了很多非常好的LLM潜在的落地相关的应用。另外一个我注意到的现象是,今年有非常多金融领域的公司作为我们的赞助商。所以我个人也很期待,大模型将来在金融领域能有什么样的突破性的发展。 赵昊:我前年去了基加利(卢旺达首都Kigali,编者注)那场,给我印象特别好。当时也是疫情后第一次 ICLR,能感觉到无论中国人还是外国人都很兴奋。两年以后再来,我觉得很意外的就是赞助商怎么这么多。因为最近几次去 CV 的会议,赞助商的数量好像都有些变少。 AI科技评论:赵老师您今年带了几篇论文过来? 赵昊:今年就带了一篇论文,是做 Conditional Image Generation 的。我的研究方法论是我们生成一些数据,然后用这些数据去训练更好的感知和决策模型。我们用 reward modeling 的方式,用diffusion从各种控制信号生成图片,让它做得更好。 AI科技评论:四位老师今年在会场上肯定看到了一些论文、演讲或者 poster。这些内容里有没有令你们印象深刻的、有趣的、好玩的东西,可以跟我们分享一下? 赵昊:那我就讲一讲我们圈子里今年一些有影响力的 paper。第一个就是今年会上的最高分 IC light,也是比较少见地拿到了满分。这个工作非常有意思,它在diffusion 里把光照做得很好。 一般大家会认为无论image diffusion还是video diffusion,生成出来的东西都不可控。目前的生成在几何和物理方面表现都不好,但IC light居然能把光照做好,这件事是非常 surprising的。同时它也是一个很好的轮子,我和很多朋友最近都在用 IC light做光照控制的工作。在CVML领域,真正有影响力的paper 是能帮助别人的paper。 我觉得IC light有影响力,最大的原因是它超前于时代。我经常跟我的学生们说,我最钦佩的科学家是能发现超越时代的、带着艺术性和灵感的东西。最典型的就是孟德尔,他在DNA双螺旋结构被发现之前300 年,就能够用设计巧妙的实验发现豌豆育种出现不同性状的比例是3:1。可能在300年、100 年、50年之后,大家看这个技术也就是那么回事,但他们就是能超前于时代把它做出来,而且还非常有实用价值,我特别喜欢这样的工作。所以在3D scene understanding and synthesis这个领域,我今年首推IC light这篇满分论文。 刘菲:我自己比较感兴趣的方向是基于大语言模型的决策系统、规划系统和推理系统。决策系统是一个蛮重要的方向,现在越来越多的用户开始问大语言模型一些复杂问题。 我可以举一个最简单的例子,比如买咖啡机有非常多的选择,可以买一个非常便宜的咖啡机做dripping coffee,也可以买一个高档一些的。大语言模型根据用户需求进行辅助决策,这就是一个非常简单的决策系统。但同时也会有一些更为复杂的决策系统,比如家里的小孩升学,在择校的时候会有非常多因素需要考虑,包括学校的地理位置、师资情况、排名、学生自身更适合哪种学校。很多时候大家只是把这些信息直接传达给大语言模型,它当然会给一个答案,但是我们没有办法验证这个决策是不是最合适的。针对单一事件做单一的决策,传统上我们基于分类器或者决策树,配合训练数据,大语言模型已经可以很好地进行辅助决策,但复杂的决策系统目前仍然是黑盒状态。 一个我们比较感兴趣的方向是如何把这两种系统集合在一起。基于传统的机器学习得到的分类器非常robust,但是只能应用于特定的任务上,而基于大语言模型的决策系统可以达到特别高的灵活性,我们想把这两种决策方式结合在一起。我们有一个系统叫做Define,主要是在金融领域针对月报或者年报,给出投资建议。 还有一个我们特别感兴趣的方向是sequential decision making,它应用于我们需要做一连串决定的场景。我举个简单的例子,如果我想制定一份新加坡旅行计划,那我首先要决定买什么时间的机票、宾馆订在什么地方。同时我要参加ICLR,每天都会有具体的行程安排。把这一连串决策放在一起,需要一个非常复杂的系统。这个决策系统需要optimize goal,可能是多找时间和大家交流,也可能是控制有限的预算,这样它才能做出最适合我的决策。说到这个,安老师有一篇paper叫Agent Studio,我特别喜欢,也希望能够听安老师讲一下这个工作的细节。 安波:谢谢刘老师。这项工作的技术性不是特别强,我们做了一个能够提供很多benchmark场景的工具,并做完了整个pipeline,可以让大家更容易地开发Agent。 我个人这两年更关注推理RL怎么和大语言模型结合在一起,以及Agent的研究。大语言模型这个概念已经出现好多年了,现在应该到了我们开始思考它落地的时刻,所以我会特别关注它在垂直领域落地方面的事情。我看了一些session,这方面的工作相对前两年还蛮多的。 刘老师刚才讲到决策系统,这也是我们所关心的。这方面有很多挑战,比如多模态的推理。4月份新加坡一座房子失火,一人死亡,还有20多人受伤。我们把几张照片发给GPT,问他能不能做一份现场处置应对的规划。我们发现GPT的规划里有很多问题,体现出它的推理能力不够。比如照片上明显显示很多小孩子受伤了,但是它推荐伤者去中央医院,实际上新加坡有一个很好的儿科医院叫KKH,离火灾场景只有3公里。 让大模型从视频里检索出必要的信息,基于这些情况进行复杂推理,这是我们未来特别想做的事情。我们希望它能规划消防人员怎么进场,需要它考虑现场视频、图片、报案的音频,再把起火大楼的平面图结合到决策中。怎么让这些技术真正地解决现实问题,还有很长的路要走。这是很有挑战的事情,但是有很多真实的应用需要。 赵俊博:我接着刚才安老师的话说。post-training的scaling是在去年九月份左右,从GPT-o1开始出现的,而ICLR的截稿日期是10月2号,所以基本上在这次的poster里很难看到跟后训练或者RL相关的工作。 这个年代发展太快了。去年10月ICLR截稿,现在文章才正式面世,但其实从去年10月到现在已经发生了太多事,包括GPT-4.5、MCP、GPT-4o生成与理解统一的非常炫目的生成效果、国内的Deepseek等等。当年ICLR出现其实是为了缩短文章面世的周期,但是现在这个周期是不是还是赶不上形势的变化,是不是需要把这些 conference 的形式再重新思考一下。 安波:现在整个pipeline还是需要三个月甚至以上,也许可以再缩短一些。 AI科技评论:我们也感觉这大半年的时间天翻地覆。赵老师你在去年九月份的时候,当时设想今年年中可能会有哪些变化? 赵俊博:我觉得有些事肯定变了,但有些事其实也没变。我对团队说的一句话就是,我们现在做很多东西都是拍脑袋。比如安老师刚才说的这个场景,虽然它很难,但其实有两种路径解决这个问题。第一种路径是multi-agent,比如可以专门做一个Agent解决消防车的调用,最后整个决策体系中穿插着各种Agent。但同时有些其他的问题可以依靠模型的底层能力直接解决。 我们可以看一下LangChain的发展,他们一开始面向multi-agent编排的技术做了很多东西,但关键是现在的base model太强大了,导致这些东西好像有一些就没有意义了。这就涉及到一个问题,有些事两年之内base model 能不能解决掉。如果不能就坚持投入,如果能解决,那我们是不是可以把这方面投入稍微退一步?关键是基于现在这种非常疯狂的变化,判别在两年内能不能解决,我感觉比较难做。 ## Scaling Law 走到尽头了吗 AI科技评论:最近对 Scaling Law 的讨论非常多。我也想请教一下四位老师的答案,Scaling Law 到底有没有走到尽头? 赵俊博:我觉得要拆领域来看。首先从 Pre-train 的角度来说,我认为已经到头了,因为确实没有数据了。人类最高质量的一批 token 加起来有10~15T,DeepSeek-V3用了14.8T。在这15T数据的基础上,如果接受比较高质量的合成数据,再把数据质量的门开得稍微大一点,我觉得差不多能扩展到25~30T,再往上就很难有更多的数据塞进来了。 Post-train方面,大家现在还是大幅依靠数学和代码这种可校验的数据。那么关键的问题是,物理、法律、心理等其他学科的数据能不能用,以及 Reward model 或者 Process Reward Model 这些相关技术能不能继续发展。或者还有没有新类型数据,比如说股票、游戏交互这些数据能不能拿来训练大模型。 其它结构上,Diffusion Language Model 暂时没有跑出 Scaling Law,我们现在看到7B、8B 有一些效果,但是非自回归的新方法还是值得期待的。 安波:我赞同赵老师的观点,我觉得Scaling Law好像要到尽头了。我们先说最近火的post training inference,它还是需要数据,需要得到那些reward signal。有人会说我们搞一个world model,但 world model也得用数据来训练,MPC建那个model,还是得从数据里面来。 刚才赵老师谈到了多智能体,有一个思考是有没有 Multi-Agent Scaling Law,我感觉这个也不存在。我是做传统多智能体的,我们发现并不见得智能体的数量增加,性能就会好,因为数量的增加会导致很多协调、通信方面的问题。我个人觉得学术界的人没有必要执着于研究 Scaling Law 是不是要走到头了,因为这个问题已经吵了很多年。 赵俊博:有没有 Scaling Law 都可以去做 research,这没什么直接关系。 刘菲:我非常同意安老师和俊博老师的想法,这里我可以再补充两点。 第一点我认为可能有一个方向还可以再深入挖掘一下,就是在谈到数据的时候,什么样的数据应该放在预训练当中,什么样的数据应该放在后训练当中。现在大家在做基础模型的时候,基本上是把能够拿到的无论是文本还是其它模态的信息,几乎是一股脑地放在预训练当中。然后在后训练阶段,对于不同的领域,会有专门的数据。其实我们可以重新思考一下这个问题,有没有可能有一种比较好的方法,能够把数据在预训练和后训练中合理地分配,最大化地提高模型能力。 另外我对 Reverse Scaling Law 也很感兴趣,我想补充的第二个方向是,在数据一定的情况下如何提高模型的能力,尤其是模型在具体任务上的能力。我们训练大模型的初衷是 predict the next word,这个任务本身并不是很重要,其实是通过这样一个简单的任务达到训练模型参数的效果。那么现在我们能不能通过在任务上的创新,提出新的task,帮助我们提高模型的后训练效果,或者模型在某一个领域需要的特定能力。我认为这两个方向,也许可以再深入挖掘一下。 像刚刚两位老师提到过的,大部分大家能够获得的高质量数据几乎已经被用掉了。这两年大语言模型持续不断地生成新的文本、图片,短视频,以后我们能够拿到的数据,会有很多是模型生成出来的。如果我们不加思考地直接用这些数据训练大语言模型,我不太确定对于模型究竟有没有质的提高。 安波:我稍微补充一下。我们 NTU 前两天邀请了一位 EPFL 的老师,他就研究这个问题。未来的数据全部是大模型产生的,一代一代地迭代下去,这个世界会变成什么样?他做了一些实验,因为是模拟所以每一代的间隔都要短得多,但是他觉得这将来会对人类的价值观,甚至一切都带来很大的变化。 赵昊:在 Vision 领域,大家比较痛心疾首的是我们还没有发现 Scaling Law。之前我们做了很久自监督的表征学习,也是想复现NLP领域的成功,但普遍认为结果不是特别成功。很多人认为这是信息密度的原因。Language 的信息密度更高,更容易出现 Scaling Law,而 vision 需要压缩信息。 我觉得 VLA 有可能在未来一段时间内看到 Scaling Law,这是非常 promising 的一件事情。我们现在做 VLA,一般是用遥操作数据做动作,做完以后复原,再重新采集数据。其实每一条数据都是差不多的,但是就用这些差不多的数据训练,50条的时候是不 work 的,200条的时候一般刚开始 work,500条数据的时候就非常 work 了。我也不知道为什么,但感觉很像 GPT 出来的时候 NLP 领域那种模模糊糊的感觉。我觉得随着这些数据积累得越来越多,也许未来12个月、24个月、36个月,突然我们的 VLA 就能做出非常灵巧的东西。 AI科技评论:刚才赵老师提到的一个问题我很好奇。您说我们有很多行业性的数据,其实现在还没有办法用来训练,是这样吗? 赵俊博:至少在今天,通过各种技术报告我们可以看到,大家后训练的主体数据还是数学和 code,这是因为我们需要一个非常明确的 reward 计算公式。数学是比较容易算 reward 的,coding 可以跑个 OJ,也有比较明确的 reward 计算方式,这些肯定是最高级的数据。次一级的数据可能需要一个 model,不管叫它 judge model 还是 reward model,总之得对模型给出的结果和实际的正确答案进行比较,这对数据的要求还是挺高的。比如你算出来答案是5,模型的输出是5,那5是不是等于5,这就是一个 reward。我觉得强化学习在大语言模型上面的空间还是比较大的,后面还是有不少事可以做。 赵昊:我有一个关于 NLP 的问题想请教一下赵老师。我以前读书的时候,大家会管 Alexnet 这种模型叫 backbone,然后会在 backbone 上做 fine tuning。现在在 NLP 领域,大家一般会管 backbone 叫 foundation model,然后后面叫 post training。现在我们定义的 post training 和 fine tuning 的区别是什么? 赵俊博:我本来想回答这两个不是一个意思,但我后来想,SFT 好像也在 post training 的范畴里。我不确定现在是不是还在,大家的术语一直在穿插。 安波:我的理解是 post training 的概念更广。Fine tuning 早期可能只有 SFT,后来加入了 RHF,但是没有把 test time 那些囊括进去。现在用 RL 做的 inference、reasoning,是不属于 fine tunning 的。 ## 模型架构尚未收敛,Diffusion 未来可期 AI科技评论:我们最近一直比较关心一个问题,扩散模型和回自回归架构在生成任务上各自有什么优劣? 赵俊博:我个人比较看好 Diffusion。我说的不是直接用一个 Diffusion Model 生成图像,我觉得 Diffusion 是个很大的概念,它可以 diffuse 很多东西。 比如清华大学朱军老师做的 RDT,整个机器可以用 Diffusion 在坐标空间的几个目标点上跑扩散过程。还有谢赛宁他们做的 Meta Query,它可以理解图像和文本,同时外接了一个 Diffusion Model,通过中间一些简单的空间上的连接,可以把 Diffusion 吐出去再去生成。这就是一个很典型的 autoregressive 和 Diffusion Model 的整合,去完成所谓的生成、理解的统一。 Diffusion 打破了自回归的限制,它的特点是可以拟合高维,可以做 Multi-Modelity 的拟合。所以我觉得 Diffusion Model 会在各种各样的地方出现,虽然 Diffusion LLM 还没有跑出 Scaling Law,但我觉得它还是未来可期。 安波:这个方向其实我们也没有做太多工作,但我感觉可能并不是那么容易切换过去。如果真的非常厉害的话,大公司早就纷纷转到那个赛道上去了。而且关于能不能取代 Transformer,我觉得可能性也不大。 AI 科技评论:对于这一点,刘菲老师怎么看? 刘菲:我们在 diffusion model上的探索也不是很多,但我比较认同俊博刚刚的观点。Diffusion model 在图像生成,或者在多模态任务上,确实展现了比较突出的优势。 我主要是做自然语言处理方向的,所以在这个领域,Autoregressive model 仍然是主流。原因在于,无论是文本数据还是一些时间序列数据,本身都具有很强的序列特性,在这种情况下我们通常更倾向于使用 Autoregressive model。当然它也有自己的问题,比如在推理(inference)阶段,很难做到并行处理。针对这一问题,目前有几个可以考虑的方向,一个是刚刚俊博提到的,将 diffusion model 和 Autoregressive model 结合起来。 另一个方向是,即便我们现在谈到 Autoregressive model 时,Transformer 确实非常成功,但近年来也有看到 recurrent neural networks(RNN)及其变种重新受到关注。这些变种在某些方面相较于 Transformer 是有一定优势的。 AI 科技评论:所以说,接下来大家很可能会探索其他架构? 刘菲:对,是这样的。 赵昊:从我的角度来看,我觉得这个问题可以分成两块。一块是 vision 本身要不要和 language 结合的问题。如果只做 vision,比如视频或图像生成的话,我们其实特别关注推理速度,所以未来一两年内,纯 vision 的任务应该会慢慢转向 AR(Auto-Regressive)思路,因为在速度上有明显优势。但圈子里还是会有很多做多模态大模型的人,他们其实并不清楚该怎么和 language 更好地结合。比如多尺度的 token 如何映射到语言空间,目前谁也说不清楚。所以我觉得,未来的发展方向是需要把这两块问题区分开来看待。 ## Agent 的机遇和挑战 AI 科技评论:最近大家对 Agent 也很关注,四位老师有什么想法吗? 赵昊:我自己做 Agent 的工作不是特别多,但最近找到了一个我认为非常有趣的方向,就是把区块链技术和 agent 通讯结合起来。我们目前正在机器人系统中,探索基于 Agent 信息交互方式,搭建一个可信的加密协同框架,我觉得这个领域非常值得深入。 区块链的特点是大家以分布式的方式共同计算,没有任何一个节点能掌握全局信息,但每个节点都参与了链的运作。区块链里有一个核心的数据结构叫 Merkle-Tree,它的特点是每个叶子节点上的计算结果都可以被有效验证,并最终在根节点完成整体计算,但叶子节点本身并不知道整体发生了什么。对应到 agent 系统中,就是每个 agent 可以参与到协作中,通过通信协议去执行任务,并最终得出结果,但每个 agent 本身并不知道整体的任务全貌。在机器人领域,这种特性非常有用。 安波:那最终你们想解决什么问题?优化的目标是什么? 赵昊:想做的是一个系统,让 agent 可以协同完成任务,而且系统具有很强的抗破坏性。 AI 科技评论:很新颖的思路!刘菲老师您怎么看? 刘菲:我觉得赵老师提到的将 agent 和区块链结合的方向,确实非常新颖,非常值得深入挖掘。我这边在 agent 方向上也有两个代表性的工作。第一个是 HARBOR[1],这是一个 multi-agent system。我们设想未来,每个人都可以拥有一个专属于自己的 personalized LLM agent,能够深度理解你的兴趣爱好,根据个性化需求,帮助你做出更合适的决策。 在这样的设定下,multi-agent system 既可能是合作关系,也可能是竞争关系。我举个例子,比如大家在申请工作时,可能都会用到一些大语言模型或者 agent 帮助修改简历、优化表达。如果只有一个职位,所有申请者之间就构成了竞争。在这种场景下,我们很感兴趣的问题是:在 multi-agent system 中,如何让 agent 同时考虑个人偏好,并帮助用户做出最具竞争力的决策。 另一个工作是 PlanGenLLMs[2],一篇综述性论文。我们对现有的 planning system 做了系统性的梳理和研究。因为现在各个 planning 系统在评测时缺乏统一标准,数据集不同,定义的 agentic capabilities 也各不相同,所以我们希望能提出一个更统一的评估方法,对各种 Agentic system 进行更科学的评估和比较。 AI 科技评论:这种系统会去考察 agent 的哪些方向? 刘菲:这是一个非常好的问题。我举几个例子,比如我们来到新加坡开会,希望让 Agent 帮我做一个出行计划,但它最终提供的方案可能并不是用户真正喜欢的,所以这就是其中一个问题。还有一种情况是,比如我的预算有限,但可以接受稍微超出的方案,或者有一些截止日期,必须严格遵守的。这种情况下,Agent 系统需要在多目标优化环境中,深刻理解哪些目标必须严格执行,哪些目标可以有一定的灵活性。这是我们评判 Agent 系统的一个重要方向。 另一个方向是我个人比较感兴趣的。因为未来很多 Agentic system 会分布到家居环境中,比如冰箱、手机等这类 edge devices,它们无法直接调用大模型,因为资源受限。所以未来的一个问题就是,如何在小模型上也能实现较强的 agentic capabilities。 AI 科技评论:那可以理解为像冰箱、手机这种设备上,会有自己的端侧小模型? 刘菲:是的,可能在端侧有一个小模型,处理一些本地任务,同时后台由大模型提供支持。一些请求可以直接在小模型上完成,另一些则发送到大模型上处理。 AI 科技评论:安波老师,您认为“小模型+Agent”是一个趋势吗? 安波:我认为是的。现在大模型的决策能力都还很弱,更不要说小模型了。总体来看,大语言模型在处理决策问题时,基本上是通过 imitation learning,即模仿已有数据。而这也解释了为什么 inference 过程如此关键。我认为未来无论是大模型还是小模型,要完成复杂决策任务,都需要引入 RL(强化学习),因为 RL 能通过与环境的交互,不断提升模型的能力。 其实刚才两位老师提到的方向,我也有研究。在做大语言模型之前,我一直在做 multi-agent system 的研究。在这个领域里,communication(通讯)是一种方式,但更关键的是如何实现 dynamic 协作优化,尤其是在机器人领域,每个 agent 如何在动态环境中高效协同,这是最困难的部分。而且刘菲老师提到的第一个方向,我认为确实是刚需,只不过这里面还有很多算法上的挑战,比如如何快速找到最优解。 AI 科技评论:安波老师,您从什么时候开始做 multi-agent system 的? 安波:我从上学期间就开始做了。稍微科普一下:这个领域起源于上世纪 80 年代,早期主要是军方为了建传感器网络。因为当时单个传感器能力弱,比如确定一辆车的位置,需要三个传感器协同定位。这就是最早的 sensor network。 后来,机器人比赛中也需要分布式协作而非集中式控制,这种场景中,Agent 完全是合作的。之后,随着互联网兴起,计算博弈论出现了;再后来,传统的 distributed planning 难以扩展,于是 distributed RL 被提出来了。到 deep learning 阶段,这一切又被进一步 deep 化。直到今天,随着大语言模型的出现,AI Agent 的概念再次被提出,但实际上,早期的 multi-agent system 已经包含了很多基础思想。 AI 科技评论:那您怎么看 RL 和 Agent 的结合呢? 安波:我认为这是未来真正落地决策型大模型的关键环节。现阶段我们还能通过充分挖掘大语言模型现有的能力,加一些工具链去完成任务。但如果要让它真正运行在现实世界中,就必须要和环境有真实交互。我们现在也在做一些相关探索,比如在 token level 上做 exploration(探索),这是一个巨大的机会领域。所以,把 RL 和大语言模型结合起来,去解决复杂决策问题,是非常重要的方向。 AI 科技评论:俊博老师最近有关注到一些相关的公司吗? 赵俊博:这种公司现在很多了,我觉得今年后面还会越来越多。比如前段时间 Manus,虽然功能上还有很多局限,但在交互体验上确实让人眼前一亮。 赵昊:写文献综述很好用。 赵俊博:这个领域我觉得肯定是有泡沫的。我也很同意安波老师刚才的看法,大模型本身的决策能力还比较弱。但不管怎么说,大家都在努力往这个方向推进。我相信今年 Agent 领域的版图还会进一步扩大。 AI 科技评论:安波老师,您最近有用过市面上的 Agent 产品吗? 安波:我用得不多,但有关注到一些,像 Manus 的评价我也看了很多。总体来说,它还是有不少值得学习的地方。 AI 科技评论:您觉得通用 Agent 是未来可能实现的目标吗? 安波:我认为肯定是 AI 发展的方向。人类对 AI 的需求不只是聊天式交互,而是希望 AI 能帮我们完成特别复杂的任务,这就是 Agent 的本质。但这条路非常难。即便今天 AI 在某些数学领域已有突破,我觉得要实现真正的通用 Agent,十年时间也很难完成。 AI 科技评论:刘菲老师,您目前的研究有没有一些能实用化的 Agent 项目呢? 刘菲:虽然我们正在做 Multi-agent system 和一些 planning 相关的算法开发,但也注意到,尽管 agent 很火,真正能落地的项目其实并不多。 这里面主要有两个潜在问题。第一个是鲁棒性问题。很多 agentic system 最后是以任务成功率作为评估标准,但目前大部分系统的成功率远达不到 90%-95%,这会在落地应用时带来很多困难。 第二个问题是安全性挑战。比如,模型生成的内容中可能包含幻觉信息,尤其是在代码生成的场景下问题更突出。正常情况下,如果 agent 正确地生成代码,是非常好的;但如果因为幻觉问题,生成了不存在的 library name,或者恶意用户提前注册了这些名字并植入了恶意代码,那后果就很严重了。当然,这只是当前我们已知的一些问题,未来随着应用的深入,肯定还会遇到更多新的挑战。所以,安全性问题必须高度重视。 赵昊:我听完刘菲老师讲的,觉得以后如果每个人都有自己的 personal agent,大家为了抢票、抢资源,不就变成了 agent 之间的战争了吗?如果以后要买一张机票,得付费买一个更厉害的 agent,感觉还挺可怕的。 AI 科技评论:竞价排名应用到个人生活里了。 赵昊:对,到那时候,要么自己处理所有复杂事务,要么就得付钱用好一点的 agent。这种趋势我觉得很快就会出现。 AI 科技评论:如果从大模型智力提升的角度来看,大家能预测一下,未来有哪些技术可能帮助模型更聪明?下一个阶段的研究趋势会是什么? 赵昊:我目前的研究方向是生成更可控的内容,进而训练出更聪明的机器人。这也是我认为提升 AI 智力的重要方式。但目前机器人的问题在于,它们在物理世界的灵敏性还远远不够。机器人领域不仅技术复杂,还涉及产业链,比如供应链,所以发展速度不像纯软件那样快。不过,随着资金和关注度的增加,机器人技术肯定会越来越快进步。 AI 科技评论:那你觉得,什么样的机器人才算是真正聪明的? 赵昊:其实现在机器人借助大语言模型的能力,已经挺聪明了。最大的问题不是智力,而是灵敏性。也就是说,当前机器人的“小脑”还不够发达,不够敏捷。 AI 科技评论:刘菲老师,您觉得该如何进一步提升大模型的智力? 刘菲:我个人认为,基础模型(pretraining model)仍然是最核心的。最初一两年里大家都在拼基础模型,最近半年虽然评测报告少了,但基础模型的重要性并没有下降。如果有一个非常稳健的基础模型,在此基础上进行长上下文扩展、强化学习(RL)微调、多模态能力扩展等,都会变得更加顺畅。而基础模型质量不好,后续的问题会层出不穷,不仅是幻觉问题。 当然,好的基础模型并不一定非得超级大。其实大概 70B 参数的模型,就可以非常好用了。虽然更大的模型可能有额外优势,但“越大越好”并不总是成立的。所以,我认为未来一个非常重要的方向,就是在适中的模型规模上,把预训练做到极致。 第二个方向,是未来半年到一年内,关于模型安全性的研究,无论是评测体系还是技术本身,都会成为重点。 最后,我也很期待大模型在交叉学科领域,比如 AI for Science、AI for Education、AI for Finance,能够带来真正突破性的进展。 AI 科技评论:安波老师,您觉得呢? 安波:我这边还是更关注决策相关的问题,无论是在 inference 阶段,还是在 multi-agent 阶段。我认为这确实是一件非常难的事情。完成一个具体任务是一方面,但如果希望进一步提升系统的鲁棒性,特别是在应用到一些此前数据未覆盖到的场景时,基本上是非常困难的。整体来说,我们还有很长的路要走。 刘菲:我非常同意安老师的观点。未来与环境的真实交互,确实是 agentic system 中非常重要的一环。 AI 科技评论:俊博老师,您的看法呢? 赵俊博:我的观点一半乐观一半悲观。乐观的地方是,LLM 的 post-training 这一条路径已经逐渐被摸索清楚了,而且今年之内依然有不少可以深挖的空间。比如说,数据目前还没有被完全穷尽,还有很多新型的数据尚未真正铺开应用。同时,算法和基础设施(Infra)方面也仍有比较大的提升空间。当然,长文本问题涉及到的一些结构体系改进,也是接下来的挑战之一。不过整体来看,一切变化发展都很快,所以最终要到今年年底,我们才能真正看到会发生什么样的新变化。 AI 科技评论:好的,那我们就静静期待,今年年底还会有哪些新的突破出现。也非常感谢四位老师今天和我们分享了这么多宝贵的内容,谢谢大家! 参考文档: 1.https://arxiv.org/pdf/2502.12149 2.https://arxiv.org/pdf/2502.11221

和《428 ~被封锁的涩谷~》有关的最新消息现已公开,由总导演石井二郎和编剧北岛行德主导的“涩谷真人冒险计划”现已公布,旨在开发和发行一款以涩谷为背景的真人冒险游戏。  ##### 本项目的特点 1.游戏系统为“群戏” :多个主角同步演绎一个故事”的群戏系统在真人版中再次得以实现。在经典的静态画面与文字的呈现方式中,再次感受到人物视角切换的多场景结构。 2.以故事情节和游戏系统为优先的开发方式:石井二郎曾表示,以往真人冒险游戏成功的关键就是“把有趣的故事情节和游戏系统放在第一位”。对于这个作品,我们将保持同样的方法,选角和宣传将在“之后”进行,而开发的重点是充分利用作为作品核心的故事情节和系统。 3. “利他主义”的游戏设计:一般来说,游戏倾向于采用专注于“如何取胜”的自私结构,但过去伟大的集体冒险游戏都以融入“利他主义”机制为特点。多个主角相互影响彼此的故事为世界观带来了深刻的现实感和乐趣。 众筹时间为:2025年5月28日(星期三)~2025年7月25日(星期六)  # 总监寄语  我为什么决定现在启动涩谷真人冒险项目?为什么您选择以个人身份工作而不是与大型游戏开发商合作?有几个原因。 首先,在制作完《428 ~被封锁的涩谷~》之后,我参与制作了一款名为《时间旅行者》的冒险游戏。托玩家们的福,游戏受到了广泛好评 当我制作《428》时,已经有了一部名为《街-命运的交叉点》的伟大先驱作品。对于我本人和当时的制作团队来说,被委托创作该系列的续集既是一个巨大的挑战,也是一项巨大的荣誉。 怎样才能超越《街-命运的交叉点》?毫无疑问,这种感觉促成了《428》的品质。 在多个角色的视角之间切换的解谜式故事体验。集体戏剧冒险游戏是一种创新的叙事技巧,只有在游戏世界中才有可能实现。正如我从《街-命运的交叉点》中继承了许多东西并创作了自己的作品一样,我相信其他人也会继承《428》的精髓并创作出他们的下一部新作品。 所以我才这么想。我认为,如果要创作出超越《428》的作品,那一定有人会来,而不是我。而且我真心相信,总有一天会出现这样的“继任者”。 然而,近20年过去了,却没有出现这样的作品。我甚至没有听到任何谣言。 相反,我一直听到的是:“我期待《街-命运的交叉点》和《428》这样的游戏。” 这是玩家们的心声。 “你能再创作一个像《428》这样的作品吗?” 事实上,我们已经与几家游戏公司就启动项目进行了认真的讨论。然而,当我们开始交谈时,总是会提到的是“能卖得更好的东西,更‘新’的东西。”“我希望像X先生/X女士这样的名人能出现在游戏中。” 事情是这样的。从商业角度来看,这种思维方式非常合理。但您所说的畅销品和新品真的是“好”吗?这是大家都在等待的吗? 似乎对于“为什么这部作品受到喜爱?为什么它留在人们心中?”这些本质问题,根本就没有理解。如果抛弃游戏的本质,只注重卖相的提升,那它最终不会是一款好游戏。 我曾不止一次或两次担心过这个问题。无论我做什么,都无法消除心中的疑虑。我一直觉得很难接受邀请演员出演作品的过程,因为他们会皱着眉头问:“这是游戏吗?” 最终,所有这些项目都失败了。回顾过去,真人游戏仅仅依靠演员的人气而成功的例子几乎没有,所以这也是理所当然的。我不想再参与这样的项目了——甚至有一段时间我也有这种想法,并远离了游戏的制作。如果有人能做到,我们就能轻松很多了……想到这里,我继续等待。 但仍然没有人制造它们。所以...让我们下定决心,自己做吧。我们不要再逃避了。我们不要再自欺欺人了。这就是这个项目的起点。 如果我们要这么做,我们希望创造出一些可以真正说是“这就是我想看到的”的东西。因此我首先联系的人是新井昌和和北上史欧。 他们两个象征着《街-命运的交叉点》和《428》。我很想看到他们两个并肩而立。只有我们能想到由他们主演的作品,没有其他人可以制作。我想和所有粉丝再次体验那种能量和氛围。为了实现这一目标,这两位领导人必须发挥带头作用。我也是这么想的。 此外,选这两个人意味着“我们将以最有趣的玩法和场景进行正面交锋!”这也是我自己决心的象征。所以我请北岛行德来写剧本。游戏形式为经典有声小说。这种风格涉及将文本叠加在现实生活的静止图像上。希望大家能够喜欢小说般的篇幅,并通过群戏的多场结构,体验“故事中的谜题”。 北岛是我最信任的编剧,《428》《时间旅行者》我都和他合作过。如果是他的剧本,我可以相信它,并尽我作为导演的最大努力将它演绎出来。这个项目就是基于这个想法而启动的。 前几天有人告诉了我这件事。他说:“石井先生并不是以创作者的身份,而是以粉丝的身份来创作这部作品的。”我认为这可能是真的。作为《街-命运的交叉点》和《428》的粉丝,我很想再次体验那种激动和震撼。也许正是这种感觉促使我开始了这个项目。 最后。我认为群戏冒险游戏的本质在于利他主义。这意味着什么?我觉得游戏本质上是一种自私的追求。大多数游戏的规则都是“为自己做点什么”——赢得胜利或得分。 不过《街-命运的交叉点》和《428》的游戏系统有所不同。为了推动故事的发展,角色需要做出“利他行为”,例如消除障碍、团结人们,有时甚至牺牲自己以便其他角色能够前进。 为别人做某事会使情况变得光明。在自私的游戏体系中看到利他主义发挥作用的乐趣。这也许就是我痴迷于集体戏剧游戏的原因。 但。我相信在现实世界中也是如此。所以,对于所有有同样感受的粉丝来说。我们将非常感谢您的帮助。我也请求你们所有人成为我的同谋。

**比亚迪宣布,全球最大汽车运输船——比亚迪“深圳号”现已启运首航。**其首航搭载超7000台新能源车前往巴西,这也是国内新能源汽车单批次出口量最多!深圳号是比亚迪第四艘汽车运输船,也是最大的一艘,滚装船全身为红白色涂装。 [](//img1.mydrivers.com/img/20250428/226123419d994448ac03d4a27ab26b5f.jpg) **据介绍,比亚迪深圳号总长219米,超过了大型驱逐舰,型宽37.7米,大约能并排放下18辆汽车,设计吃水9米,最多可装载9200辆汽车(此前3艘最多能装7000辆)。** 另外,比亚迪第五艘汽车运输船“长沙号”也即将下水,跟深圳号一样大,也是比亚迪第二艘9200辆运输船。 [](//img1.mydrivers.com/img/20250428/b6f9a536e3f341279b766286753cff29.jpg) [查看评论](https://m.cnbeta.com.tw/comment/1495858.htm)

4月28日消息,根据机构最新发布的2024财年全球车企净利润排名,日本车企丰田汽车以2586.2亿元的净利润蝉联榜首,展现出其在全球汽车市场中的强劲盈利能力。紧随其后的是大众集团和梅赛德斯·奔驰,分别以1029.2亿元和864亿元的净利润位列第二、第三名。现代汽车、宝马汽车、本田汽车、特斯拉、保时捷、Stellantis和起亚也成功跻身前十,反映出全球汽车行业头部企业的竞争格局。 **在中国车企方面,比亚迪以402.5亿元的净利润位列第13名,成为排名最靠前的中国车企。这一成绩体现了比亚迪在新能源汽车领域的领先地位,也彰显了中国车企在全球市场中的崛起势头。此外,理想汽车也以80.5亿元的净利润排在第25位。** 然而,并非所有中国车企都交出了满意的答卷。江淮汽车、零跑汽车、小鹏汽车、北汽蓝谷以及蔚来汽车等车企在2024财年的净利润均为负值。这反映出这些车企在面临市场竞争加剧、成本控制压力以及产品策略调整等多重挑战时,仍需努力提升盈利能力。 值得注意的是,特斯拉作为唯一进入前十的美国车企,其净利润表现虽然不及丰田等传统车企巨头,但在全球新能源汽车市场中仍占据重要地位。而保时捷作为豪华品牌代表,其高净利润也再次证明了高端市场在汽车行业中的盈利能力。  [查看评论](https://m.cnbeta.com.tw/comment/1495856.htm)

**据马克・古尔曼最新报道,苹果正在开发两款20周年纪念版iPhone,将在2027年发布。**按照当年10周年iPhone X的路线来看,20周年版本可能会再次变革手机形态。 **古尔曼透露,第一款是用户期待已久的苹果可折叠iPhone,第二款据说是以玻璃为中心的Pro版。**  根据时间线来看,目前苹果首款折叠屏稳步推进,已经进入到试产阶段,预计2026年下半年就会开始量产,可能在2026年9月随iPhone 18系列同台发布。 **20周年纪念版应该是第二代折叠屏iPhone,会在2027年9月发布,届时应该会针对第一代的用户反馈进行一些微调和完善。** 据爆料,目前的折叠屏iPhone内屏是全面屏形态,尺寸是7.76英寸,分辨率是2713×1920。 首发苹果屏下摄像头技术,这将是苹果史上第一款真全面屏iPhone。  外屏仍然是挖孔形态,尺寸是5.49英寸,分辨率是2088×1422。 **至于以玻璃为中心的Pro版目前没有过多消息,推测有可能是采用Unibody方案,让中框与背壳融为一体,就像当年小米MIX陶瓷一体后壳的效果。** [查看评论](https://m.cnbeta.com.tw/comment/1495852.htm)

在昨日举办的第十六届中国国际核电工业展览会上,**我国首个核电工业操作系统——中广核“智能核电”正式发布。**中国广核集团表示,“智能核电”共包含机组启停顺序控制和工艺成组控制、智能巡检和重要设备智能运维等38项研发成果。 目前已完成软件、硬件开发和测试验证,在机组试点应用过程中,**“智能核电”实现了比现有报警系统提前20天发出设备预警信号。**  未来,它将作为中广核新建核电站的标准配置,在新开工的“华龙一号”机组中全面应用。 据了解,**“华龙一号”是我国具有完全自主知识产权的第三代核电技术,每台核电机组每年发电超100亿度。** 截至目前,中广核共有16台“华龙一号”核电机组,2台已商运,14台在建,分布在广东、广西、浙江、福建、山东等地。  [查看评论](https://m.cnbeta.com.tw/comment/1495850.htm)

360董事长周鸿祎日前来到重庆荣昌,与卤鹅哥“林江”一起体验荣昌美食和文化。在此期间,**周鸿祎被路人问到“360借条是不是可以不用还了?”,周鸿祎则回应称“那不是我的公司”。** 周鸿祎的回应也让不少网友感到意外,毕竟360借条此前还是360集团的核心盈利板块,现在怎么直接不是他的公司了。 天眼查数据显示,360借条(现奇富借条)的实际运营主体是奇富科技(原360数科),**该公司成立于2017年,2022年从360集团分拆独立并在港交所上市。** 根据股权穿透,周鸿祎作为天津奇信志成科技有限公司法人,以及其它控股公司间接持有奇富科技约13.8%的股份,为第一大股东。 **不过,在法律上奇富科技已独立于360集团运营,**并且,周鸿祎于2024年8月辞任奇富科技董事及董事会主席职务,不再直接参与管理,这或许是周鸿祎说360借条不是他的公司的原因。 [](//img1.mydrivers.com/img/20250428/844b5ebffc9749549ef936f66bae60cf.png) [查看评论](https://m.cnbeta.com.tw/comment/1495848.htm)

钛媒体 · 黑白之键

钛媒体 · 黑白之键 小众软件 · 青小蛙

小众软件 · 青小蛙 人人都是产品经理 · Ben的AI实验室

人人都是产品经理 · Ben的AI实验室 嘶吼 · 胡金鱼

嘶吼 · 胡金鱼 36氪

36氪 cnBeta全文版

cnBeta全文版 雷峰网

雷峰网 机核 · 单梦蛙

机核 · 单梦蛙